python批量读取txt文件为DataFrame的方法

更新时间:2018年04月03日 10:38:04 作者:MUSK1881

下面小编就为大家分享一篇python批量读取txt文件为DataFrame的方法,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧

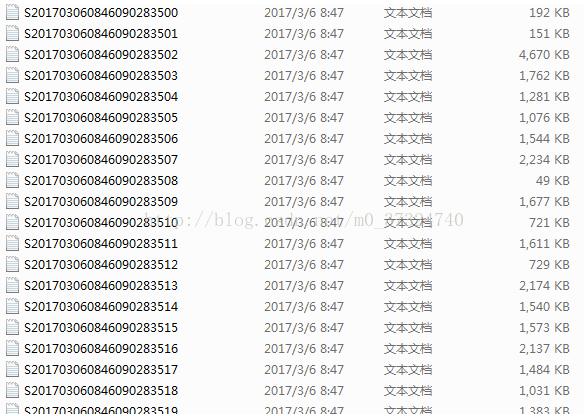

我们有时候会批量处理同一个文件夹下的文件,并且希望读取到一个文件里面便于我们计算操作。比方我有下图一系列的txt文件,我该如何把它们写入一个txt文件中并且读取为DataFrame格式呢?

首先我们要用到glob模块,这个python内置的模块可以说是非常的好用。

glob.glob('*.txt')

得到如下结果:

all.txt是我最后得到的结果文件。可以见返回的是一个包含txt文件名称的列表,当然如果你的文件夹下面只有txt文件,那么你用os.listdir()可以得到一个一样的列表

然后读取的时候只要注意txt文件的编码格式(可以用notepad++打开记事本查看)和间隔符的形式就好了,完整的代码如下:

import os

import pandas

import codecs

import glob

import pandas as pd

os.getcwd()

os.chdir('D:\AAAASXQ\python study\data preprocessing')

def txtcombine():

files = glob.glob('*.txt')

all = codecs.open('all.txt','a')

for filename in flist:

print(filename)

fopen=codecs.open(filename,'r',encoding='utf-8')

lines=[]

lines=fopen.readlines()

fopen.close()

i=0

for line in lines:

for x in line:

all.write(x)

#读取为DataFrame格式

all1 = pd.read_csv('all.txt',sep=' ',encoding='GB2312')

#保存为csv格式

all1.to_csv('all.csv',encoding='GB2312')

if __name__ == '__main__':

txtcombine()

以上这篇python批量读取txt文件为DataFrame的方法就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持脚本之家。

最新评论