Python爬虫基础之requestes模块

一、爬虫的流程

开始学习爬虫,我们必须了解爬虫的流程框架。在我看来爬虫的流程大概就是三步,即不论我们爬取的是什么数据,总是可以把爬虫的流程归纳总结为这三步:

1.指定 url,可以简单的理解为指定要爬取的网址

2.发送请求。requests 模块的请求一般为 get 和 post

3.将爬取的数据存储

二、requests模块的导入

因为 requests 模块属于外部库,所以需要我们自己导入库

导入的步骤:

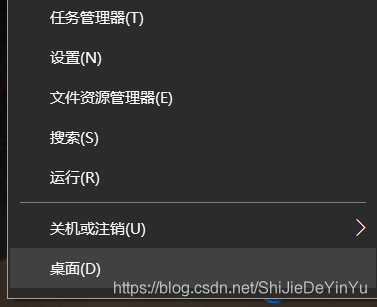

1.右键Windows图标

2.点击“运行”

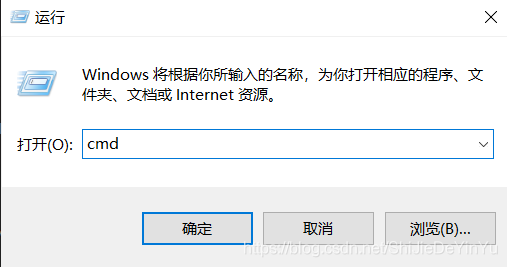

3.输入“cmd”打开命令面板

4.输入“pip install requests”,等待下载完成

如图:

如果还是下载失败,我的建议是百度一下,你就知道(我也是边学边写,是在是水平有限)

欧克,既然导入成功后我们就简单的来爬取一下搜狗的首页吧!

三、完整代码

import requests

if __name__ == "__main__":

# 指定url

url = "https://www.sougou.com/"

# 发起请求

# get方法会返回一个响应数据

response = requests.get(url)

# 获取响应数据

page_txt = response.text # text返回一个字符串的响应数据

# print(page_txt)

# 存储

with open("./sougou.html", "w", encoding = "utf-8") as fp:

fp.write(page_txt)

print("爬取数据结束!!!")

我们打开保存的文件,如图

欧克,这就是最基本的爬取,如果学会了,那就试一试爬取 B站 的首页吧。

到此这篇关于Python爬虫基础之requestes模块的文章就介绍到这了,更多相关Python requestes模块内容请搜索脚本之家以前的文章或继续浏览下面的相关文章希望大家以后多多支持脚本之家!

相关文章

python进阶教程之循环相关函数range、enumerate、zip

这篇文章主要介绍了python进阶教程之循环相关函数range、enumerate、zip,在使用循环程序经常要配合这些函数来完成循环,需要的朋友可以参考下2014-08-08

Python使用BeautifulSoup和Scrapy抓取网页数据的具体教程

在当今信息爆炸的时代,数据无处不在,如何有效地抓取、处理和分析这些数据成为了许多开发者和数据科学家的必修课,本篇博客将深入探讨如何使用Python中的两个强大工具:BeautifulSoup和Scrapy来抓取网页数据,需要的朋友可以参考下2025-01-01

最新评论