Claude Code接入国产大模型(GLM/Qwen)配置全解析

Claude Code 接入国产大模型(GLM / Qwen)配置说明

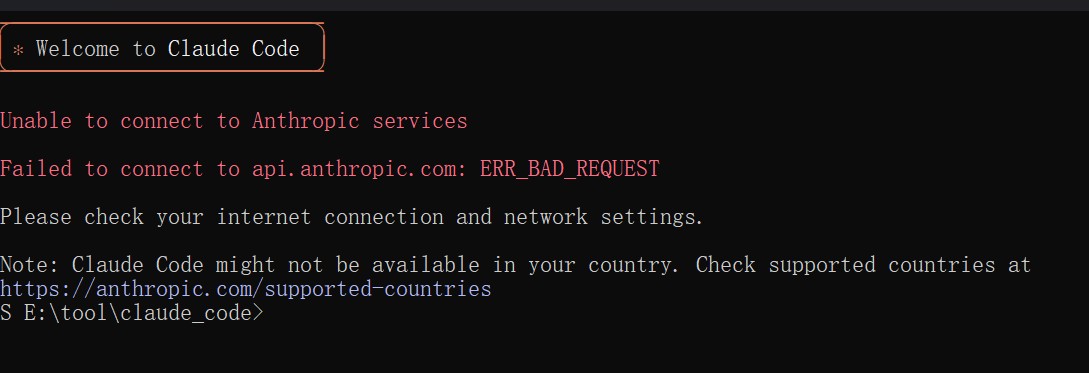

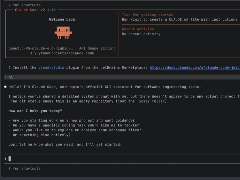

用 Claude Code 时,很多人会遇到两个比较现实的问题:

- 网络不稳定

- 成本不可控

其实它本身并没有强绑定模型,只是走 Anthropic 的接口协议。只要服务端兼容这套协议,就可以换成其他模型。

常见的替代方案:

- 智谱AI 的 GLM

- 阿里云 的 Qwen

配置也不复杂,核心就是一个 settings.json。

一、配置示例

GLM

{

"env": {

"ANTHROPIC_BASE_URL": "https://open.bigmodel.cn/api/anthropic",

"ANTHROPIC_API_KEY": "xxxx",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-4.5-air",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "glm-4.5-air",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "glm-4.5-air"

}

}Qwen

{

"env": {

"ANTHROPIC_BASE_URL": "https://dashscope.aliyuncs.com/apps/anthropic",

"ANTHROPIC_API_KEY": "x-xxx",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "qwen3.5-plus",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "qwen3.5-flash",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "qwen3-coder-next"

}

}二、核心思路

本质就两件事:

- 换接口地址(Base URL)

- 换模型名称

Claude Code 不关心你用的是不是 Claude,只认接口格式。

三、关键参数说明

1. ANTHROPIC_BASE_URL

请求地址,决定流量打到哪里。

- 默认:官方接口

- 现在:国产模型兼容接口

2. ANTHROPIC_API_KEY

接口鉴权。

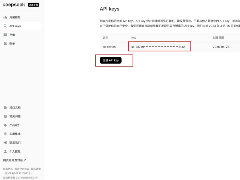

四、API Key 正确姿势

1. macOS / Linux

写入:

~/.zshrc # 或 ~/.bashrc

内容:

export ANTHROPIC_API_KEY=你的key export ANTHROPIC_BASE_URL=https://open.bigmodel.cn/api/anthropic

执行:

source ~/.zshrc

2. Windows

setx ANTHROPIC_API_KEY "xxxx" setx ANTHROPIC_BASE_URL "https://open.bigmodel.cn/api/anthropic"

注意:需要重新打开终端才生效

3. settings.json 可以简化

用了上述环境变量之后,settings.json 里就不用再写 Key 和 URL 了,只留模型名就够:

{

"env": {

"ANTHROPIC_DEFAULT_OPUS_MODEL": "qwen3.5-plus",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "qwen3-coder-next",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "qwen3-coder-next"

}

}export 临时设的环境变量关掉终端就没了,别用这个方式做日常配置,调试可以。

4. 临时变量什么时候用

临时变量(export / $env:)只在当前终端有效:

- 关掉窗口就失效

- 不适合长期使用

它更适合:

- 临时测试

- 多模型快速切换

正常使用还是建议用“持久化变量”,如:上述示例中的配置

5. 运行时怎么切换模型

配了多档之后,Claude Code 有两种方式在运行时切换。

会话内切换(最常用)

启动 claude 进入交互模式后,直接输入:

/model

会弹出一个交互菜单,列出可选档位,选完立刻生效,不需要重启。

也可以直接带参数:

/model opus # 切到 ANTHROPIC_DEFAULT_OPUS_MODEL 对应的模型 /model sonnet # 切到 ANTHROPIC_DEFAULT_SONNET_MODEL 对应的模型 /model haiku # 切到 ANTHROPIC_DEFAULT_HAIKU_MODEL 对应的模型

这里的 opus / sonnet / haiku 是档位别名,不是模型全名——Claude Code 会自动读你配置里对应的那个模型名。配的是 qwen3.5-plus,输 /model opus 走的就是它。

6. 启动时指定(整个会话固定用某一档)

claude --model opus # 本次会话全程用 OPUS 档 claude --model sonnet # 本次会话全程用 SONNET 档 claude --model haiku # 本次会话全程用 HAIKU 档

适合明确知道这次任务偏重还是偏轻的情况,不用中途再手动切。

7. 查当前用的哪个

/status

显示当前模型,不会改变任何设置。

实际用法大概是:平时默认走 sonnet 档,碰到复杂重构 /model opus 临时换一下,搞完再切回来。

8. 几个容易踩的坑

- Base URL 末尾不要加斜杠,路径要精确,对不上就 404

- 模型名必须和平台文档一致,大小写都算,写错直接报错

- Key 要确认有对应模型的调用权限,不是所有套餐都开放全部模型

- 网络延迟因人而异,建议实测再决定用哪个

配置文件里看到的 "hasCompletedOnboarding": true 之类的字段,是 Claude Code 自己写的初始化标记,忽略即可,不影响模型行为。

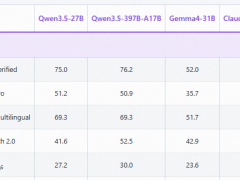

五、重点:三个模型参数说明

ANTHROPIC_DEFAULT_OPUS_MODEL ANTHROPIC_DEFAULT_SONNET_MODEL ANTHROPIC_DEFAULT_HAIKU_MODEL

这三个参数其实是“模型分层”。

1. 分别代表什么

| 参数 | 对应角色 | 触发场景 |

|---|---|---|

OPUS | 重型模型 | 复杂重构、多步骤任务 |

SONNET | 主力模型 | 日常写代码、改 bug |

HAIKU | 轻量模型 | 简单补全、快速问答 |

2. 实际使用差异

OPUS

- 复杂逻辑

- 大段代码修改

- 多步骤任务

特点:稳,但慢一点

SONNET

- 日常写代码

- 改 bug

- 普通问答

基本是主力模型

HAIKU

- 简单补全

- 小问题

特点:快,但可能不够细

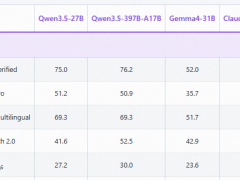

六、国产模型要不要三档分开

结论:不强制,但建议至少分两档

原因:

- 国产模型分层没有那么细

- 有些只是不同性能版本

七、推荐配置方式

1. 一档(最简单)

{

"ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-4.5-air",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "glm-4.5-air",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "glm-4.5-air"

}2. 两档(更推荐)

{

"ANTHROPIC_DEFAULT_OPUS_MODEL": "qwen3.5-plus",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "qwen3-coder-next",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "qwen3-coder-next"

}3. 三档(精细配置)

{

"ANTHROPIC_DEFAULT_OPUS_MODEL": "qwen3.5-plus",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "qwen3.5-flash",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "qwen3-coder-next"

}八、常见问题

- 接口必须用

/anthropic - 模型名要和平台一致

- API Key 要有权限

- 延迟需要自己测

九、总结

核心就三步:

- 换 Base URL

- 配 API Key

- 配置模型

关键点:环境变量建议用“持久化方式”,临时变量只适合测试

以上就是Claude Code接入国产大模型(GLM/Qwen)配置全解析的详细内容,更多关于Claude Code接入国产大模型的资料请关注脚本之家其它相关文章!

相关文章

本地安装Claude Code+自定义API接口的全配置指南

Claude Code 是Anthropic官方推出的AI 编程助手,可以直接在终端、VS Code、JetBrains 等 IDE 中使用,本文详细介绍了Claude Code的安装方法、环境要求、首次登录步骤以及如2026-05-06

在Claude Code中接入DeepSeek-V4的完整指南

Claude Code的价值,在于把代码理解、修改、执行和验证整合进同一条工作链路,如果你已经在使用Claude Code,又希望把底层模型切换到DeepSeek-V4,这篇文章可以直接帮你完2026-05-06

Claude Code接入DeepSeek兼容端点的配置教程

文章介绍了如何通过环境变量配置将ClaudeCode的API后端切换为DeepSeek提供的Anthropic兼容端点,详细说明了在Windows和Linux/macOS上的配置步骤,并提供了完整的配置示例,还2026-05-01

Qwen3.6-27B 本地私有化部署 + Claude Code 连接应用

本文主要介绍 Qwen3.6-27B 的本地私有化部署过程,部署采用vLLM 引擎,以及将 Claude Code 指向使用私有化部署的模型,并且开发一个五子棋的网页小游戏,以及针对开源项目2026-04-29

Claude Code接入SonarQube静态扫描的实战指南

SonarQube 是业界最流行的代码质量平台之一,能检测 Bug、漏洞、坏味道、安全热点,还能统计覆盖率和重复代码,而现在,它可以直接集成进 Claude Code,让 AI 在帮你写代码2026-04-28

Claude Code零改动接入DeepSeek V4的详细过程

文章介绍了cc-use工具,作为ClaudeCodeDe的启动器,解决了在不同不同Anthropop提供者之间切换时环境变量冲突的问题,文章详细描述了如何使用cc-use工具接通DeepSeekV4端点,需2026-04-28 本文介绍了如何快速配置ClaudeCode连接本地LMStudio服务的使用指南,包括验证LMStudio服务可用性、配置ClaudeCode全局连接、避免认证冲突的方法、热切换模型的操作步骤,帮2026-04-14

本文介绍了如何快速配置ClaudeCode连接本地LMStudio服务的使用指南,包括验证LMStudio服务可用性、配置ClaudeCode全局连接、避免认证冲突的方法、热切换模型的操作步骤,帮2026-04-14

claude code无法连接到Anthropic服务解决办法

有时候我们的setting.json配置文件 和 环境变量 都设置好了之后, 我们打开claude code依然提示错误,这篇文章主要介绍了claude code无法连接到Anthropic服务的相关资料,需2026-04-13

2026最新Claude Code的安装并连接VScode的保姆级教程(使用CC Switch或o

本文详细介绍了使用ClaudeCode和CCSwitch在本地部署Claude,并连接深Seek、智谱AI、Ollama等模型的过程,最后说明了在VScode中使用Claude的方法,本文结合图文、示例代码给大2026-04-10

Claude Code完整安装使用教程(含国内模型接入方案)

文章介绍了AI编程助手ClaudeCode的安装、使用和配置方法,包括安装步骤、接入国内编程模型、简单使用案例及注意事项等内容,需要的朋友可以参考下2026-04-09

最新评论