Ollama

Ollama是一个开源的本地大语言模型运行框架,专为在本地机器上便捷部署和运行大型语言模型(LLM)而设计。

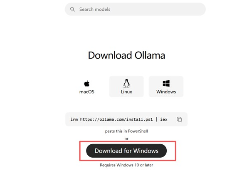

Ollama支持多种操作系统,包括macOS、Windows、Linux以及通过Docker容器运行。

Ollama提供对模型量化的支持,可以显著降低显存要求,使得在普通家用计算机上运行大型模型成为可能。

Python + Ollama 本地跑大模型:零成本搭建你的私有 AI 助手

文章介绍Ollama本地AI助手的安装方法,从环境准备、快速上手到实战项目,并探讨了其核心优势,包括零成本、零数据风险、零门槛和零妥协,通过使用Ollama,用户可以在本地运行大模型,支持多...2026-04-09

Ollama最新版安装包下载和安装步骤(开源,简单,小白5分钟学会)

本文详细介绍了Ollama的安装流程,包括Windows和Linux两个平台的安装步骤,以及如何修改模型存储路径和使用示例,本文给大家介绍的非常详细,感兴趣的朋友跟随小编一起看看吧...2026-03-06

Ollama 简单安装(windows/mac/linux/docker)

Ollama 支持多种操作系统,包括 macOS、Windows、Linux 以及通过 Docker 容器运行,Ollama 对硬件要求不高,旨在让用户能够轻松地在本地运行、管理和与大型语言模型进行交互...2026-03-07

Windows11下Ollama部署Qwen2.5大模型的实战指南

本文旨在记录 如何在Windows 11 本地环境下,利用 Ollama 部署 Qwen2.5 大模型,并实现 API 调用,无需显卡也能跑”、能够确保隐私安全,有需要的小伙伴可以跟随小编一起了解一下...2026-03-18

共1页/19条