查看Ollama GPU资源使用情况的两种方法

发布时间:2026-03-09 10:41:59 作者:老赵全栈实战  我要评论

我要评论

本文主要介绍了如何查看Ollama的GPU内存使用情况,包括通过命令行工具ollamaps和任务管理器两种方法,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧

📅 今日知识点

- 核心主题:Ollama GPU内存使用情况查看及监控方法

💻 如何查看Ollama的GPU内存使用情况

方法1. 通过ollama ps

通过命令"ollama ps"来查看当前运行的模型及其资源占用情况是最直接的方法:

# 查看当前运行的模型及资源使用情况 ollama ps

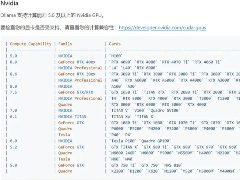

输出示例:

关键字段说明:

- NAME:模型名称和版本

- ID:模型ID

- SIZE:模型文件大小,即模型权重大小

- PROCESSOR:当前的共享GPU和专用GPU使用百分比,其中CPU指共享GPU

- CONTEXT:模型上下文窗口的内存占用

- UNTIL:模型运行了多长时间

实用技巧:

# 持续监控(每2秒刷新一次)

watch -n 2 ollama ps

# Windows PowerShell 等效命令(每2秒执行一次)

while ($true) { ollama ps; Start-Sleep 2 }

方法2. Windows平台下通过任务管理器查看

对于Windows用户,可以通过图形界面直观查看资源使用情况:

操作步骤:

- 按

Ctrl + Shift + Esc打开任务管理器 - 切换到「详细信息」选项卡

- 找到

ollama.exe进程 - 右键点击标题行 →「选择列(S)」→ 把「GPU」相关的列显示处理

查看要点:

- GPU:显示进程的GPU使用率

- 专用 GPU 内存:显示显存占用情况

- 共享 GPU 内存:显示系统内存作为显存使用的情况

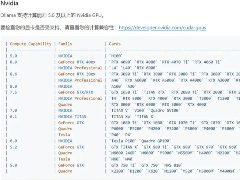

下图展示了笔者环境中的情况:

此外,还可以在任务管理器的性能页面,查看GPU的总体使用情况,具体情况如下图所示:

到此这篇关于查看Ollama GPU资源使用情况的两种方法的文章就介绍到这了,更多相关Ollama GPU资源使用内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

本文介绍了在Windows系统上配置Ollama使用GPU加速的步骤,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起2026-04-30

本文介绍了在Windows系统上配置Ollama使用GPU加速的步骤,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起2026-04-30

最新评论