超轻量级OpenClaw本地部署与一键安装、配置指南

超轻量级OpenClaw本地部署指南:一键安装与配置

1. 引言

想拥有自己的AI助手但被复杂的部署过程劝退?今天介绍的OpenClaw超轻量版本,让你在几分钟内就能在本地搭建一个功能完整的AI助手。这个版本只有原版1%的代码量,但保留了核心的智能体功能,包括文件操作、代码执行、网页搜索等实用能力。

无论你是想学习AI智能体原理,还是需要一个轻量级的个人助手,这个教程都能帮你快速上手。不需要深厚的技术背景,跟着步骤走,你就能拥有一个随时待命的AI小助手。

2. 环境准备与快速安装

2.1 系统要求

在开始之前,确保你的系统满足以下基本要求:

- Python 3.8 或更高版本

- 至少 4GB 可用内存

- 稳定的网络连接(用于下载依赖包)

2.2 一键安装步骤

打开终端,执行以下命令完成安装:

# 使用pip直接安装稳定版本 pip install nanobot-ai # 或者从源码安装(推荐,方便后续自定义) git clone https://github.com/HKUDS/nanobot.git cd nanobot pip install -e .

安装过程通常只需要1-2分钟,取决于你的网络速度。如果遇到权限问题,可以在命令前加上sudo。

2.3 验证安装

安装完成后,运行以下命令检查是否安装成功:

nanobot --version

如果显示版本号,说明安装成功。

3. 基础配置与初始化

3.1 初始化工作区

第一次使用时,需要初始化工作目录:

nanobot onboard

这个命令会创建必要的配置文件和目录结构,通常只需要几秒钟。

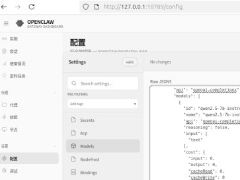

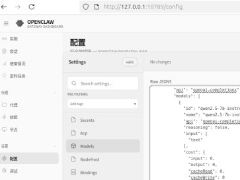

3.2 配置API密钥

编辑配置文件 ~/.nanobot/config.json,添加你的API密钥:

{

"providers": {

"openrouter": {

"apiKey": "你的OpenRouter密钥"

}

},

"agents": {

"defaults": {

"model": "anthropic/claude-sonnet"

}

}

}如果你还没有API密钥,可以去OpenRouter官网免费注册获取。他们提供多种模型选择,包括Claude、GPT等。

3.3 测试配置

配置完成后,运行测试命令确认一切正常:

nanobot agent -m "你好,请自我介绍"

如果看到AI助手的回复,说明配置成功。

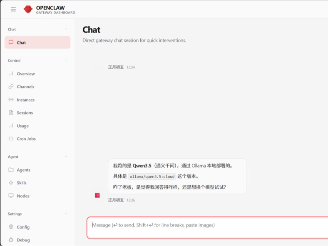

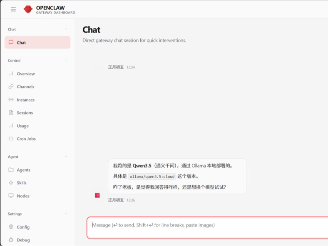

4. 核心功能体验

4.1 基础对话功能

现在你可以开始与AI助手对话了:

# 单次对话 nanobot agent -m "2+2等于多少?" # 进入交互模式 nanobot agent

交互模式下,你可以连续对话,输入exit或quit退出。

4.2 文件操作能力

试试让AI助手帮你处理文件:

nanobot agent -m "请创建一个test.txt文件,内容为'Hello World'"

AI助手会使用内置的文件工具完成这个任务。

4.3 网页搜索功能

配置Brave搜索API后,AI助手可以联网获取信息:

{

"tools": {

"web": {

"search": {

"apiKey": "你的Brave搜索密钥"

}

}

}

}

然后就可以询问实时信息:

nanobot agent -m "今天有什么科技新闻?"

5. 本地模型部署

5.1 使用vLLM部署本地模型

如果你希望完全离线运行,可以使用vLLM部署本地模型:

# 启动vLLM服务 vllm serve meta-llama/Llama-3.1-8B-Instruct --port 8000

5.2 配置本地模型

修改配置文件,指向本地服务:

{

"providers": {

"vllm": {

"apiKey": "dummy",

"apiBase": "http://localhost:8000/v1"

}

},

"agents": {

"defaults": {

"model": "meta-llama/Llama-3.1-8B-Instruct"

}

}

}

现在AI助手就会使用你的本地模型了。

6. 常见问题解决

6.1 安装失败处理

如果pip安装失败,可以尝试以下方法:

# 更新pip pip install --upgrade pip # 使用虚拟环境 python -m venv nanobot-env source nanobot-env/bin/activate pip install nanobot-ai

6.2 API密钥错误

如果遇到API密钥错误,检查以下几点:

- 密钥是否正确复制,没有多余空格

- OpenRouter账户是否有足够的额度

- 网络连接是否正常

6.3 内存不足问题

如果运行大型模型时内存不足,可以:

- 使用更小的模型版本

- 增加系统交换空间

- 关闭其他占用内存的程序

7. 进阶配置建议

7.1 自定义工具扩展

你可以根据需要添加自定义工具:

# 在nanobot目录下创建custom_tools.py

from nanobot.tools import tool

@tool

def custom_function(input_text: str) -> str:

"""这是一个自定义工具示例"""

return f"处理结果: {input_text.upper()}"7.2 定时任务设置

设置定时提醒或定期任务:

# 每天上午9点发送问候 nanobot cron add --name "morning_greeting" --message "早上好!" --cron "0 9 * * *"

8. 总结

整体体验下来,这个超轻量版的OpenClaw确实让人惊喜。安装配置过程比想象中简单很多,基本上跟着步骤走就不会出错。功能方面虽然比完整版精简,但核心的对话、文件操作、网页搜索都保留了,对个人使用来说完全够用。

最让我喜欢的是它的轻量化设计,启动速度快,资源占用低,即使在配置不高的机器上也能流畅运行。而且代码结构清晰,想要自定义功能或者学习AI智能体原理都很方便。

如果你刚接触AI助手,建议先从简单的功能开始尝试,熟悉后再逐步探索更复杂的应用场景。本地模型部署部分可能需要一些技术基础,但云端API的方式对新手非常友好。

到此这篇关于超轻量级OpenClaw本地部署与一键安装与配置指南的文章就介绍到这了,更多相关OpenClaw本地部署内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

Windows端本地部署OpenClaw的正确方法与避坑指南(拒绝失败率)

打开 OpenClaw 官网,你会看到官方提供了一行命令来安装,但如果你是 Windows 用户,千万不要直接执行一行命令安装,失败率极高,如果你是新手小白,我手把手带你养龙虾,凑2026-03-11

Windows、macOS、Linux三系统本地部署OpenClaw+避坑指南+Docker一键部

本文给大家分享全网最全的OpenClaw安装部署教程,覆盖Windows、macOS、Linux三系统本地部署,并最终提供Docker一键部署方案,感兴趣的朋友一起看看吧2026-03-10

Windows本地部署OpenClaw并连接Ollama模型的完整指南

本文档基于实际部署经验编写,旨在帮助大家在 Windows 系统上从零开始搭建 OpenClaw,并连接本地 Ollama 模型(如 Qwen2.5 或 Qwen3),使其具备完整的智能体能力,有需要的2026-03-10

OpenClaw+Ollama+Qwen3.5:cloud/Qwen3:0.6b部署本地离线部署AI大模型(

无需GPU、无需云端API,在Windows10/11电脑上,手把手教你部署Ollama+Qwen3.5:cloud(主力模型)+Qwen3:0.6b(轻量备选)+OpenClaw,实现本地离线运行私人AI,感兴趣的可以2026-03-10 本文给大家分享本地部署OpenClaw安装配置使用教程,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友参考下吧2026-03-09

本文给大家分享本地部署OpenClaw安装配置使用教程,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友参考下吧2026-03-09

OpenClaw飞书插件本地部署时的高频报错 spawn EINVAL问题及解决方案

本文介绍在Windows和Mac环境下使用nvm管理Node.js进行OpenClaw飞书插件本地部署时遇到的spawnEINVAL报错问题,并提供了报错原因分析、无效尝试汇总到解决方案的步骤,帮助开2026-03-07 本文详细介绍如何在 macOS 本地部署 OpenClaw 智能助理框架,从环境准备到首次运行,手把手教你搭建属于自己的 AI 助理,适合零基础新手,全程实操无坑,需要的朋友可以参考2026-03-06

本文详细介绍如何在 macOS 本地部署 OpenClaw 智能助理框架,从环境准备到首次运行,手把手教你搭建属于自己的 AI 助理,适合零基础新手,全程实操无坑,需要的朋友可以参考2026-03-06 OpenClaw是本地优先、开源、可自主执行任务的 AI 智能体框架,不是单纯的聊天机器人,也不是大模型本身,而是把大模型变成能“真干活”的数字员工,这篇文章主要介绍了OpenC2026-03-06

OpenClaw是本地优先、开源、可自主执行任务的 AI 智能体框架,不是单纯的聊天机器人,也不是大模型本身,而是把大模型变成能“真干活”的数字员工,这篇文章主要介绍了OpenC2026-03-06 本文详细介绍了在macOS/Linux/Windows系统上进行本地部署的步骤,并展示了如何配置飞书机器人以实现飞书内的AI对话,文中通过示例代码介绍的非常详细,需要的朋友们下面随着2026-03-05

本文详细介绍了在macOS/Linux/Windows系统上进行本地部署的步骤,并展示了如何配置飞书机器人以实现飞书内的AI对话,文中通过示例代码介绍的非常详细,需要的朋友们下面随着2026-03-05 OpenClaw(原Clawdbot/Moltbot)是一款开源的本地优先AI代理与自动化平台,支持多渠道通信集成、大模型调用及自动化任务执行,可满足个人与小型团队的智能辅助需求,这篇文章主2026-03-02

OpenClaw(原Clawdbot/Moltbot)是一款开源的本地优先AI代理与自动化平台,支持多渠道通信集成、大模型调用及自动化任务执行,可满足个人与小型团队的智能辅助需求,这篇文章主2026-03-02

最新评论