OpenClaw接入阿里云永久免费模型解决方案

Qwen2.5-7B-Instruct 模型为例

一、前置准备工作

1. 阿里云灵积账号与 API 准备

注册与实名认证:

打开 阿里云灵积 DashScope 平台,注册/登录账号。

完成个人实名认证(推荐支付宝刷脸,1分钟完成,无需绑卡),这是解锁永久免费模型的唯一门槛。

如下图所示:

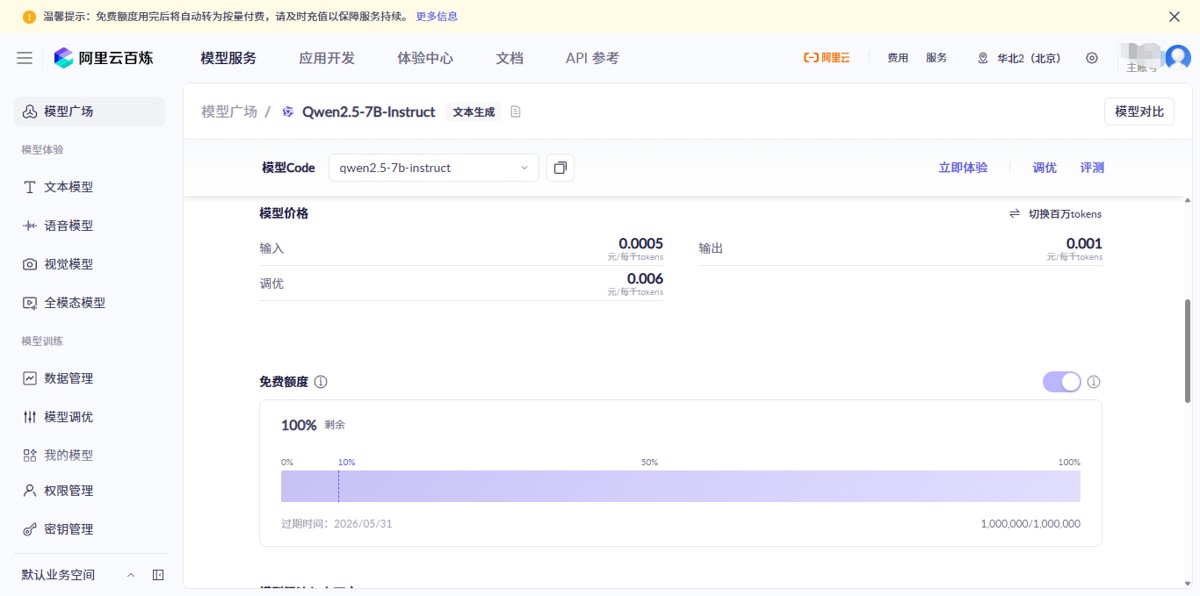

开通模型服务:

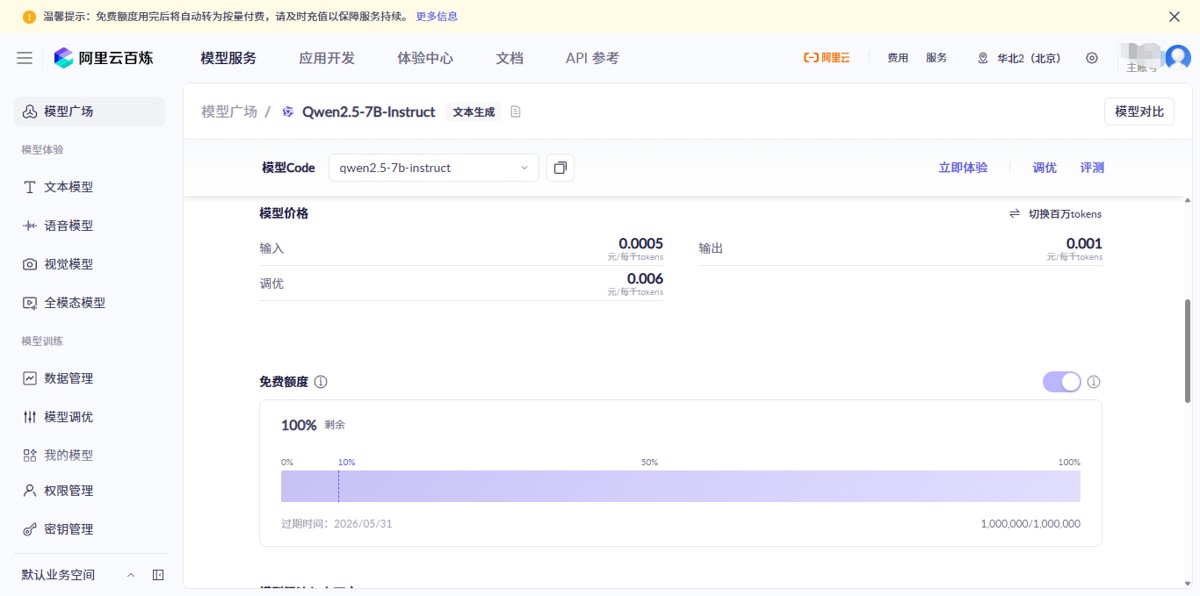

- 进入「模型广场」,搜索

qwen2.5-7b-instruct,点击模型卡片进入详情页,如下图所示:

- 进入「模型广场」,搜索

生成 API Key:

进入控制台左侧「API-KEY 管理」,点击「创建新的 API-KEY」,自定义名称后点击确定。

立即复制并保存 API Key(可以随时复制)。

如下图所示:

开启防扣费开关(必做):

- 回到

qwen2.5-7b-instruct模型详情页,找到「免费额度用完即停」开关,切换为开启状态(紫色),确保额度耗尽后自动进入永久免费通道,不会扣费。

- 回到

另外免费额度说明:

- 当前页面的 100 万 tokens 免费额度,是平台给多模态模型的新用户专属限时体验额度,仅能用于这个 Qwen2.5-VL-32B-Instruct 模型,90日后就会过期,过期后未用完的额度也会直接清零,和永久免费文本模型的额度不互通、不通用。

- 如果你的核心需求是 OpenClaw 的网页抓取、长文档汇总、竞品调研,纯文本的qwen2.5-7b-instruct永久免费款完全够用,不会有额度和时间限制;只有当你需要用到图片理解、图文解析能力时,才需要用到 VL 系列多模态模型,这部分没有永久免费权益。

2. OpenClaw 环境与权限预处理

确保 OpenClaw 已正确安装并能基本运行。

修复潜在权限问题(避免后续浏览器/文件访问报错):

# 停止当前 OpenClaw 服务 openclaw stop # 递归修正配置目录所有者为当前用户(将 tht 替换为你的实际用户名) sudo chown -R tht:tht /home/tht/.openclaw # 修正目录读写权限 chmod -R 755 /home/tht/.openclaw

二、配置方法(三种可选)

方法一:Web UI 界面配置

全程鼠标操作,自动处理配置格式,不会出错。

启动 OpenClaw 并打开 UI:

openclaw gateway start

浏览器访问

http://127.0.0.1:18789或http://localhost:18789。进入配置页面:

- 点击左侧菜单「配置」或「Settings」,选择「Models」(模型)选项卡。

添加模型提供商:

点击「Add Provider」(添加提供商),选择

OpenAI Compatible(OpenAI 兼容模式)。按以下表格严格填写参数:

| 配置项 | 填写内容 |

|---|---|

| Provider Name(提供商名称) | 自定义,如 Aliyun-Qwen |

| Base URL(接口地址) | 必须填:https://dashscope.aliyuncs.com/compatible-mode/v1 |

| API Key | 粘贴你之前复制的阿里云 API Key |

添加模型:

- 在刚添加的提供商下,点击「Add Model」(添加模型),按以下表格填写:

| 配置项 | 填写内容 |

|---|---|

| Model ID(模型ID) | qwen2.5-7b-instruct |

| Model Name(模型名称) | 自定义,如 Qwen2.5-7B (永久免费) |

| Context Window(上下文窗口) | 必须填≥16000,推荐直接填 32768(模型原生最大值) |

| Max Output Tokens(最大输出) | 推荐填 8192 |

| Cost(费用) | 全填 0 |

保存并应用配置:

- 点击「Save」(保存),再点击「Apply」(应用),让配置实时生效。

(可选)设为默认模型:

- 进入「Agents」(智能体)设置,在「Default Model」(默认模型)下拉菜单中选择刚添加的

qwen2.5-7b-instruct,保存即可。

- 进入「Agents」(智能体)设置,在「Default Model」(默认模型)下拉菜单中选择刚添加的

方法二:命令行向导配置(openclaw configure)

适合偏好命令行的用户,工具自动处理配置合并。

备份配置文件(以防万一):

cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.backup

运行配置向导:

openclaw configure

按向导提示操作:

选择

Model (Pick provider + credentials),按回车确认。选择

Add a new model provider。提供商类型选择

OpenAI-compatible。按以下内容填写关键参数(其他步骤按需填写):

| 向导步骤 | 填写内容 |

|---|---|

| Provider Name | aliyun-qwen |

| API Key | 粘贴你的阿里云 API Key |

| Base URL | https://dashscope.aliyuncs.com/compatible-mode/v1 |

| Model ID | qwen2.5-7b-instruct |

| Context Window Size | 32768(必须≥16000) |

| Max Output Tokens | 8192 |

| Model Alias(模型别名) | qwen(后续用 /model qwen 快速切换) |

| Set as default model? | 按需选 y(是)或 n(否) |

保存并退出向导,重启 OpenClaw 生效:

openclaw stop && openclaw start

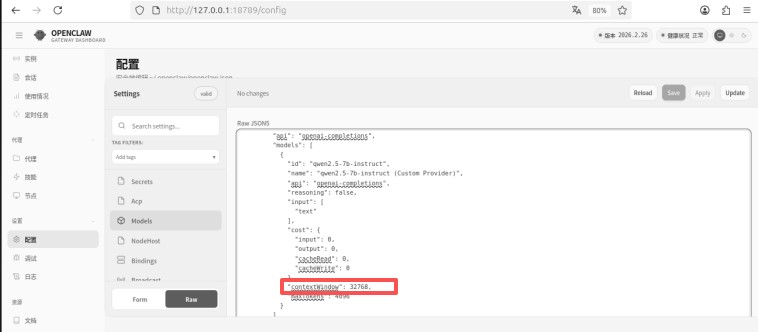

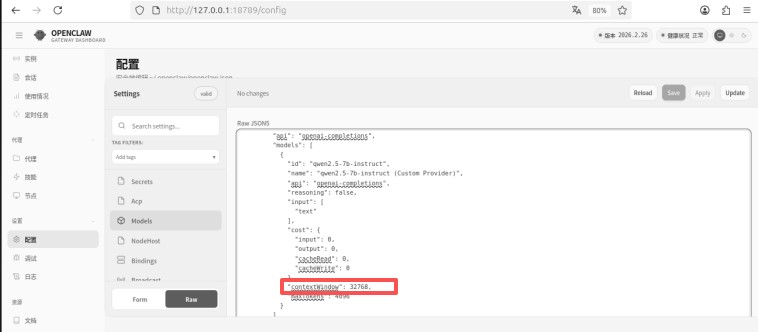

方法三:手动修改 JSON 配置

仅当前两种方法不生效时使用,需严格注意语法。

备份配置文件:

cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.backup

用编辑器打开配置文件:

nano ~/.openclaw/openclaw.json

按以下结构修改/添加配置(仅展示核心修改部分,保留原有的 Kimi 等配置):

{ "auth": { "profiles": { "aliyun:default": { "provider": "openai", "mode": "api_key" } } }, "models": { "mode": "merge", "providers": { "aliyun": { "baseUrl": "https://dashscope.aliyuncs.com/compatible-mode/v1", "api": "openai-chat", "models": [ { "id": "qwen2.5-7b-instruct", "name": "Qwen2.5-7B-Instruct", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 32768, "maxTokens": 8192 } ] } } }, "agents": { "defaults": { "model": { "primary": "aliyun/qwen2.5-7b-instruct" }, "models": { "aliyun/qwen2.5-7b-instruct": { "alias": "Qwen" } } } } }保存并退出:按

Ctrl+O保存,按Ctrl+X退出。

如下图所示:

校验 JSON 语法(必须做,避免

invalid config报错):jq . ~/.openclaw/openclaw.json

输出完整 JSON 内容且无报错,代表语法正确。

通过命令行配置 API Key(不要写在 JSON 里,不安全):

openclaw config set auth.profiles.aliyun:default.apiKey "你的阿里云API-KEY"

重启 OpenClaw 生效:

openclaw gateway restart

三、核心避坑指南(必须阅读,避免重复踩坑)

接口地址红线:

必须使用 OpenAI 兼容地址:

https://dashscope.aliyuncs.com/compatible-mode/v1严禁使用灵积原生 API 域名,否则 OpenClaw 无法适配。

上下文窗口红线:

contextWindow必须 ≥ 16000,推荐直接填 32768(Qwen2.5-7B 原生最大值),否则会报Model context window too small错误。

JSON 语法红线:

所有标点必须是英文半角字符,严禁使用中文逗号

,、中文引号“”。手动修改后必须用

jq或在线 JSON 校验工具检查语法。

权限问题:

- 若之前用

sudo/root运行过 OpenClaw,必须按前置准备中的步骤修复目录权限,否则会出现EACCES: permission denied报错。

- 若之前用

API Key 安全:

- 优先通过 Web UI 或

openclaw config set命令配置 API Key,不要直接写在 JSON 文件里。

- 优先通过 Web UI 或

四、验证配置成功

重启 OpenClaw 服务:

openclaw gateway restart

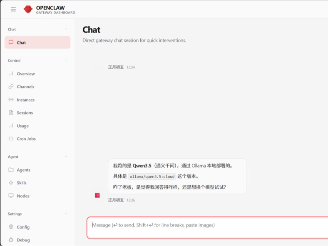

切换模型并测试:

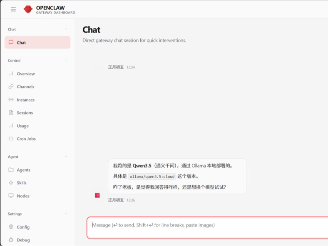

打开 Web UI 对话界面,输入

/model Qwen(或你设置的模型别名)切换到 Qwen 模型。发送测试消息,如“你好,请介绍一下自己”,确认能正常收到回复。

(可选)发送一个长文本或网页抓取任务,确认不再出现上下文窗口报错。

如下图所示:

在千问中消耗的tokens如下图所示:

神奇的是在kimi claw中居然还可以继续使用,不过用的是Qwen模型了,如下图所示:

五、常见问题快速排查

| 报错信息 | 核心原因 | 解决方法 |

|---|---|---|

invalid config | JSON 语法错误(中文标点、括号不匹配等) | 用 jq . ~/.openclaw/openclaw.json 检查语法,修正错误标点 |

Model context window too small (4096 tokens). Minimum is 16000. | 上下文窗口配置值过小 | 将 contextWindow 修改为 32768,保存并重启 |

EACCES: permission denied | 配置文件/目录权限被锁定 | 按前置准备中的步骤执行 chown 和 chmod 命令修复权限 |

| 模型连接失败/无响应 | API Key 错误、接口地址错误或模型未开通 | 检查 API Key 是否正确、Base URL 是否为兼容地址、模型是否在灵积平台开通 |

六、接入了模型后,一切就感觉不可控了

你可以直接在chat窗口告诉他你想要配置的模型信息,让他自己配置,就行了,只要动动嘴皮子,它就可以自己搞定。

如下图所示:

也可以在kimi claw中搞一把,如下图所示:

同时可以看到配置文件:

总结

到此这篇关于OpenClaw接入阿里云永久免费模型解决方案的文章就介绍到这了,更多相关OpenClaw接入阿里云永久免费模型内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

Windows端本地部署OpenClaw的正确方法与避坑指南(拒绝失败率)

打开 OpenClaw 官网,你会看到官方提供了一行命令来安装,但如果你是 Windows 用户,千万不要直接执行一行命令安装,失败率极高,如果你是新手小白,我手把手带你养龙虾,凑2026-03-11

Windows、macOS、Linux三系统本地部署OpenClaw+避坑指南+Docker一键部

本文给大家分享全网最全的OpenClaw安装部署教程,覆盖Windows、macOS、Linux三系统本地部署,并最终提供Docker一键部署方案,感兴趣的朋友一起看看吧2026-03-10

Windows本地部署OpenClaw并连接Ollama模型的完整指南

本文档基于实际部署经验编写,旨在帮助大家在 Windows 系统上从零开始搭建 OpenClaw,并连接本地 Ollama 模型(如 Qwen2.5 或 Qwen3),使其具备完整的智能体能力,有需要的2026-03-10

OpenClaw+Ollama+Qwen3.5:cloud/Qwen3:0.6b部署本地离线部署AI大模型(

无需GPU、无需云端API,在Windows10/11电脑上,手把手教你部署Ollama+Qwen3.5:cloud(主力模型)+Qwen3:0.6b(轻量备选)+OpenClaw,实现本地离线运行私人AI,感兴趣的可以2026-03-10 本文给大家分享本地部署OpenClaw安装配置使用教程,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友参考下吧2026-03-09

本文给大家分享本地部署OpenClaw安装配置使用教程,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友参考下吧2026-03-09

OpenClaw飞书插件本地部署时的高频报错 spawn EINVAL问题及解决方案

本文介绍在Windows和Mac环境下使用nvm管理Node.js进行OpenClaw飞书插件本地部署时遇到的spawnEINVAL报错问题,并提供了报错原因分析、无效尝试汇总到解决方案的步骤,帮助开2026-03-07 本文详细介绍如何在 macOS 本地部署 OpenClaw 智能助理框架,从环境准备到首次运行,手把手教你搭建属于自己的 AI 助理,适合零基础新手,全程实操无坑,需要的朋友可以参考2026-03-06

本文详细介绍如何在 macOS 本地部署 OpenClaw 智能助理框架,从环境准备到首次运行,手把手教你搭建属于自己的 AI 助理,适合零基础新手,全程实操无坑,需要的朋友可以参考2026-03-06 本文详细介绍了在macOS/Linux/Windows系统上进行本地部署的步骤,并展示了如何配置飞书机器人以实现飞书内的AI对话,文中通过示例代码介绍的非常详细,需要的朋友们下面随着2026-03-05

本文详细介绍了在macOS/Linux/Windows系统上进行本地部署的步骤,并展示了如何配置飞书机器人以实现飞书内的AI对话,文中通过示例代码介绍的非常详细,需要的朋友们下面随着2026-03-05 OpenClaw(原Clawdbot/Moltbot)是一款开源的本地优先AI代理与自动化平台,支持多渠道通信集成、大模型调用及自动化任务执行,可满足个人与小型团队的智能辅助需求,这篇文章主2026-03-02

OpenClaw(原Clawdbot/Moltbot)是一款开源的本地优先AI代理与自动化平台,支持多渠道通信集成、大模型调用及自动化任务执行,可满足个人与小型团队的智能辅助需求,这篇文章主2026-03-02 OpenClaw超轻量版本地部署指南介绍了一个功能完整且轻量级的AI助手,适用于学习和使用,该指南详细介绍了环境准备、快速安装、基础配置、核心功能体验等步骤,安装配置过程比2026-03-02

OpenClaw超轻量版本地部署指南介绍了一个功能完整且轻量级的AI助手,适用于学习和使用,该指南详细介绍了环境准备、快速安装、基础配置、核心功能体验等步骤,安装配置过程比2026-03-02

最新评论