OpenClaw使用Ollama本地模型的实现(支持工具调用))

Ollama 是一个本地 LLM 运行时,可以轻松在你的机器上运行开源模型。OpenClaw 通过 Ollama 的 OpenAI 兼容 API 进行集成,并且当你通过 OLLAMA_API_KEY(或认证配置)启用且未定义显式的 models.providers.ollama 条目时,可以自动发现支持工具调用的模型。

快速开始

- 安装 Ollama:https://ollama.ai

- 拉取模型:

ollama pull llama3.3 # 或 ollama pull qwen2.5-coder:32b # 或 ollama pull deepseek-r1:32b

- 为 OpenClaw 启用 Ollama(任意值即可;Ollama 不需要真实密钥):

# 设置环境变量 export OLLAMA_API_KEY="ollama-local" # 或在配置文件中设置 openclaw config set models.providers.ollama.apiKey "ollama-local"

- 使用 Ollama 模型:

{

agents: {

defaults: {

model: { primary: "ollama/llama3.3" },

},

},

}模型发现(隐式提供商)

当你设置了 OLLAMA_API_KEY(或认证配置)且未定义 models.providers.ollama 时,OpenClaw 会从本地 Ollama 实例 http://127.0.0.1:11434 发现模型:

- 查询

/api/tags和/api/show - 仅保留报告了

tools能力的模型 - 当模型报告

thinking时标记为reasoning - 在可用时从

model_info["<arch>.context_length"]读取contextWindow - 将

maxTokens设置为上下文窗口的 10 倍 - 所有费用设置为

0

这样无需手动配置模型条目,同时保持目录与 Ollama 的能力对齐。查看可用模型:

ollama list openclaw models list

要添加新模型,只需通过 Ollama 拉取:

ollama pull mistral

新模型将被自动发现并可供使用。如果你显式设置了 models.providers.ollama,自动发现将被跳过,你必须手动定义模型(见下文)。

配置

基本设置(隐式发现)

启用 Ollama 最简单的方式是通过环境变量:

export OLLAMA_API_KEY="ollama-local"

显式设置(手动模型)

在以下情况使用显式配置:

- Ollama 运行在其他主机/端口上。

- 你想强制指定上下文窗口或模型列表。

- 你想包含未报告工具支持的模型。

{

models: {

providers: {

ollama: {

// 使用包含 /v1 的主机地址以兼容 OpenAI API

baseUrl: "http://ollama-host:11434/v1",

apiKey: "ollama-local",

api: "openai-completions",

models: [

{

id: "llama3.3",

name: "Llama 3.3",

reasoning: false,

input: ["text"],

cost: { input: 0, output: 0, cacheRead: 0, cacheWrite: 0 },

contextWindow: 8192,

maxTokens: 8192 * 10

}

]

}

}

}

}如果设置了 OLLAMA_API_KEY,你可以在提供商条目中省略 apiKey,OpenClaw 会自动填充以进行可用性检查。

自定义基础 URL(显式配置)

如果 Ollama 运行在不同的主机或端口上(显式配置会禁用自动发现,因此需要手动定义模型):

{

models: {

providers: {

ollama: {

apiKey: "ollama-local",

baseUrl: "http://ollama-host:11434/v1",

},

},

},

}模型选择

配置完成后,所有 Ollama 模型即可使用:

{

agents: {

defaults: {

model: {

primary: "ollama/llama3.3",

fallbacks: ["ollama/qwen2.5-coder:32b"],

},

},

},

}高级用法

推理模型

当 Ollama 在 /api/show 中报告 thinking 时,OpenClaw 会将模型标记为具有推理能力:

ollama pull deepseek-r1:32b

模型费用

Ollama 免费且在本地运行,因此所有模型费用均设置为 $0。

上下文窗口

对于自动发现的模型,OpenClaw 会使用 Ollama 报告的上下文窗口(如果可用),否则默认为 8192。你可以在显式提供商配置中覆盖 contextWindow 和 maxTokens。

故障排除

Ollama 未被检测到

确保 Ollama 正在运行,且你已设置 OLLAMA_API_KEY(或认证配置),并且未定义显式的 models.providers.ollama 条目:

ollama serve

同时确认 API 可访问:

curl http://localhost:11434/api/tags

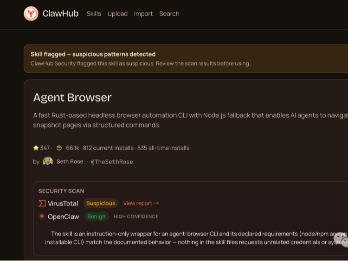

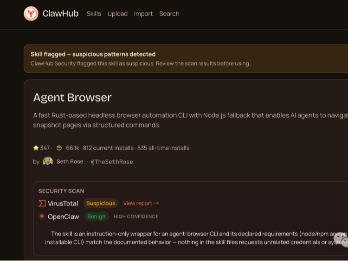

没有可用模型

OpenClaw 仅自动发现报告了工具支持的模型。如果你的模型未列出,可以:

- 拉取一个支持工具调用的模型,或

- 在

models.providers.ollama中显式定义该模型。

添加模型:

ollama list # 查看已安装的模型 ollama pull llama3.3 # 拉取模型

连接被拒绝

检查 Ollama 是否在正确的端口上运行:

# 检查 Ollama 是否在运行 ps aux | grep ollama # 或重启 Ollama ollama serve

另请参阅

到此这篇关于OpenClaw使用Ollama本地模型(支持工具调用))的文章就介绍到这了,更多相关OpenClaw使用Ollama本地模型内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

Windows本地部署OpenClaw并连接Ollama模型的完整指南

本文档基于实际部署经验编写,旨在帮助大家在 Windows 系统上从零开始搭建 OpenClaw,并连接本地 Ollama 模型(如 Qwen2.5 或 Qwen3),使其具备完整的智能体能力,有需要的2026-03-10

OpenClaw+Ollama+Qwen3.5:cloud/Qwen3:0.6b部署本地离线部署AI大模型(

无需GPU、无需云端API,在Windows10/11电脑上,手把手教你部署Ollama+Qwen3.5:cloud(主力模型)+Qwen3:0.6b(轻量备选)+OpenClaw,实现本地离线运行私人AI,感兴趣的可以2026-03-10 本指南重点介绍 OpenClaw + Ollama,我还会讲解最常见的问题、API 模式的重要性、如何设置本地+云端混合流程,以及如何避免本地模型输出过于冗长,感兴趣的朋友跟随小编一起2026-03-05

本指南重点介绍 OpenClaw + Ollama,我还会讲解最常见的问题、API 模式的重要性、如何设置本地+云端混合流程,以及如何避免本地模型输出过于冗长,感兴趣的朋友跟随小编一起2026-03-05

Linux环境下配置openclaw并连接到局域网ollama模型

本文介绍了如何在Linux环境下配置OpenClaw并连接到局域网内的ollama模型,包括环境准备、部署步骤、配置provider和model、飞书插件安装与配置,以及消息测试和定时任务设置,2026-03-04 本文详细介绍了在Mac上本地安装和配置OpenClaw,包括下载模型、搭建环境、配置agentskills等步骤,文中通过示例代码介绍的非常详细,需要的朋友们下面随着小编来一起学习学2026-03-11

本文详细介绍了在Mac上本地安装和配置OpenClaw,包括下载模型、搭建环境、配置agentskills等步骤,文中通过示例代码介绍的非常详细,需要的朋友们下面随着小编来一起学习学2026-03-11

最新评论