OpenClaw怎么换大模型?3步免费切换各种大模型配置教程

一句话总结:OpenClaw 本身不内置任何大模型,而是通过灵活的配置机制对接各类模型服务。更换模型只需三步:选择目标模型获取 API Key、在配置文件中添加模型提供商、重启网关生效。支持云端模型(元宝、豆包、DeepSeek、智谱 GLM 等)、本地私有化模型(Ollama、LM Studio)、以及任何兼容 OpenAI API 协议的自定义模型,完全免费或低成本使用,可同时配置多个模型实现智能降级切换。

引言:为什么要换掉你的“龙虾大脑”?

OpenClaw 被戏称为“龙虾”——它能操作文件、控制浏览器、跨应用协同、甚至操控硬件设备,是名副其实的“AI 执行引擎”。但很多人忽略了一个关键问题:OpenClaw 本身不包含任何 AI 模型。

就像一台性能再强的电脑,没有操作系统也无法工作。OpenClaw 的“大脑”完全来自你接入的大模型。这意味着:

- 用得好不好,取决于你配了什么模型

- 花钱多不多,取决于你选了免费还是付费模型

- 隐私安不安全,取决于你用云端还是本地模型

更关键的是,OpenClaw 支持同时配置多个模型,可以设置主模型和降级模型,当主模型超限或不可用时自动切换。这种“双保险”机制,让“龙虾”永不掉线。

本文将基于截至 2026 年 3 月的官方文档和社区实践,从核心原理、云端模型配置、本地私有化部署、高级配置技巧、常见问题五个维度,手把手教你为 OpenClaw 更换最合适的“大脑”。

第一章:核心原理——OpenClaw 如何对接大模型?

1.1 为什么需要更换模型?

OpenClaw 的核心价值在于“连接”——连接大模型的思考能力与电脑的真实操作权限。不同模型各有优劣:

| 需求场景 | 推荐模型类型 | 原因 |

|---|---|---|

| 日常对话、文档处理 | 元宝、智谱 GLM | 中文理解强,免费额度充足 |

| 复杂推理、代码生成 | DeepSeek、Claude | 逻辑能力强,代码表现优异 |

| 数据隐私敏感场景 | 本地模型(Ollama/LM Studio) | 数据不出本地,完全离线可用 |

| 成本敏感、高频使用 | 元宝、豆包免费 API | 零成本或极低成本 |

| 多语言场景 | GPT、Claude | 英文及多语言能力强 |

1.2 OpenClaw 的模型配置架构

OpenClaw 的模型配置通过一个 JSON 文件完成,默认路径为:

- Linux/MacOS:

~/.openclaw/openclaw.json - Windows:

C:\Users\用户名\.openclaw\openclaw.json

核心配置结构如下:

{

"models": {

"providers": {

"提供商ID": {

"baseUrl": "API地址",

"apiKey": "你的API密钥",

"api": "openai-completions",

"models": [

{

"id": "模型ID",

"name": "显示名称",

"contextWindow": 上下文长度,

"maxTokens": 最大输出Token数

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "提供商ID/模型ID",

"fallback": "备用提供商ID/模型ID"

}

}

}

}配置逻辑解析:

- providers:定义模型供应商(可配置多个)

- baseUrl:API 接入地址,必须兼容 OpenAI API 格式

- apiKey:认证密钥,支持环境变量引用(如

${MY_API_KEY}) - models:该供应商下的具体模型列表

- primary/fallback:主模型和降级模型,实现高可用

1.3 支持的三类模型

| 类型 | 代表平台 | 接入方式 | 成本 |

|---|---|---|---|

| 云端商业模型 | 腾讯元宝、百度千帆、智谱、DeepSeek | API Key | 按量付费/免费额度 |

| 云端免费模型 | 元宝免费版、豆包、各大平台赠送额度 | API Key | 完全免费 |

| 本地私有化模型 | Ollama、LM Studio | 本地 API | 完全免费(需硬件) |

1.4 模型切换的核心操作

OpenClaw 提供了三种切换模型的方式,适应不同使用习惯:

| 切换方式 | 命令/操作 | 适用场景 |

|---|---|---|

| Web 面板切换 | 点击右上角模型选择器下拉菜单 | 日常使用,最直观 |

| 命令行切换 | openclaw models set 提供商/模型ID | 开发者,批量操作 |

| 对话内切换 | 输入 /model list、/model 模型ID | 快速测试对比 |

快速命令示例:

# 查看所有已配置模型 openclaw models list # 查看当前默认模型 openclaw models current # 切换默认模型 openclaw models set yuanbao/hunyuan-turbo # 临时切换单次对话(不改变默认) openclaw chat --model yuanbao/hunyuan-turbo --prompt "测试"

第二章:云端模型配置——接入主流大模型

2.1 腾讯元宝模型配置(推荐中文场景)

腾讯元宝基于混元大模型,提供强大的中文理解和多模态能力,2026 年推出免费额度方案,大幅降低使用门槛。

第一步:获取 API Key

- 登录腾讯云官网,进入「元宝大模型控制台」

- 在左侧菜单找到「API 密钥管理」,点击「创建密钥」

- 复制并妥善保存生成的 API Key(格式类似

sk-xxx)

省钱提示:腾讯元宝提供每日免费额度,适合个人开发者和中小企业测试使用。

第二步:配置 OpenClaw

编辑配置文件 ~/.openclaw/openclaw.json:

{

"models": {

"providers": {

"yuanbao": {

"baseUrl": "https://yuanbao.tencentcloudapi.com/v1",

"apiKey": "sk-你的API密钥",

"api": "openai-completions",

"models": [

{

"id": "hunyuan-turbo",

"name": "混元 Turbo",

"contextWindow": 128000,

"maxTokens": 8192

},

{

"id": "hunyuan-pro",

"name": "混元 Pro",

"contextWindow": 256000,

"maxTokens": 16384

},

{

"id": "hunyuan-lite",

"name": "混元 Lite",

"contextWindow": 32768,

"maxTokens": 4096

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "yuanbao/hunyuan-turbo"

}

}

}

}第三步:重启网关生效

openclaw gateway restart

元宝免费版配置(零成本方案):

{

"models": {

"providers": {

"yuanbao-free": {

"baseUrl": "https://yuanbao.tencentcloudapi.com/free/v1",

"apiKey": "你的免费版API Key",

"api": "openai-completions",

"models": [

{

"id": "hunyuan-free",

"name": "混元免费版",

"contextWindow": 32768,

"maxTokens": 8192

}

]

}

}

}

}2.2 豆包模型配置

字节跳动豆包以出色的多模态能力和创意生成著称,提供免费 API 额度。

获取 API Key:

- 访问字节火山引擎控制台

- 进入「豆包大模型」服务

- 创建 API Key 并复制保存

配置示例:

{

"models": {

"providers": {

"doubao": {

"baseUrl": "https://ark.cn-beijing.volces.com/api/v3",

"apiKey": "你的豆包API Key",

"api": "openai-completions",

"models": [

{

"id": "doubao-pro-32k",

"name": "豆包 Pro 32K",

"contextWindow": 32768,

"maxTokens": 8192

},

{

"id": "doubao-lite-128k",

"name": "豆包 Lite 128K",

"contextWindow": 128000,

"maxTokens": 16384

}

]

}

}

}

}2.3 DeepSeek 模型配置

DeepSeek 以强大的代码能力和推理能力著称,是开发者的热门选择。

获取 API Key:访问 DeepSeek 开放平台 → 注册账号 → 创建 API Key

配置示例:

{

"models": {

"providers": {

"deepseek": {

"baseUrl": "https://api.deepseek.com/v1",

"apiKey": "sk-你的DeepSeek密钥",

"api": "openai-completions",

"models": [

{

"id": "deepseek-chat",

"name": "DeepSeek Chat",

"contextWindow": 65536,

"maxTokens": 8192

},

{

"id": "deepseek-coder",

"name": "DeepSeek Coder",

"contextWindow": 32768,

"maxTokens": 8192

}

]

}

}

}

}2.4 智谱 GLM 模型配置

智谱 AI 的 GLM 系列模型中文理解优秀,提供免费额度。

获取 API Key:

- 访问智谱 AI 开放平台,注册账号

- 进入「控制台」→「API Keys」

- 点击「添加新的 API Key」,复制保存

配置示例:

{

"models": {

"providers": {

"zhipu": {

"baseUrl": "https://open.bigmodel.cn/api/paas/v4",

"apiKey": "你的智谱API Key",

"api": "openai-completions",

"models": [

{

"id": "glm-4-plus",

"name": "GLM-4 Plus",

"contextWindow": 128000,

"maxTokens": 8192

},

{

"id": "glm-4-flash",

"name": "GLM-4 Flash",

"contextWindow": 32768,

"maxTokens": 4096

}

]

}

}

}

}2.5 百度千帆模型配置

百度千帆平台提供 ERNIE 系列模型。

配置示例:

{

"models": {

"providers": {

"qianfan": {

"baseUrl": "https://qianfan.baidubce.com/v2",

"apiKey": "你的千帆API Key",

"api": "openai-completions",

"models": [

{

"id": "ERNIE-5.0",

"name": "ERNIE 5.0",

"contextWindow": 128000,

"maxTokens": 8192

}

]

}

}

}

}2.6 自定义模型供应商(任意 OpenAI 兼容 API)

如果以上官方模型都不满足需求,OpenClaw 支持接入任何兼容 OpenAI API 协议的模型服务。

适用场景:

- 使用公司内部部署的模型服务

- 接入新兴模型平台的 API

- 使用硅基流动等聚合平台

配置格式:

{

"models": {

"providers": {

"custom": {

"baseUrl": "https://your-model-api.com/v1",

"apiKey": "your_api_key",

"api": "openai-completions",

"models": [

{

"id": "your-model-id",

"name": "Your Model Name"

}

]

}

}

}

}示例:接入硅基流动 DeepSeek 模型

{

"models": {

"providers": {

"siliconflow": {

"baseUrl": "https://api.siliconflow.cn/v1",

"apiKey": "你的硅基流动API Key",

"api": "openai-completions",

"models": [

{

"id": "deepseek-ai/DeepSeek-V3.2",

"name": "DeepSeek V3.2"

}

]

}

}

}

}第三章:本地私有化模型部署——完全免费、数据隐私

对于追求数据隐私、希望完全免费的场景,本地部署是理想选择。本地模型完全离线运行,无 Token 限制、无订阅费用、数据不出设备。

3.1 方案一:使用 Ollama 部署本地模型

Ollama 是目前最简单易用的本地模型部署工具,支持 Windows、macOS、Linux。

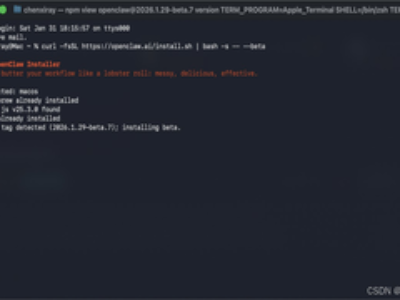

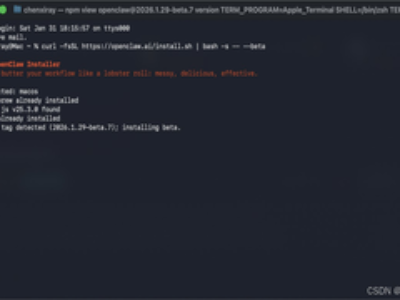

第一步:安装 Ollama

# MacOS / Linux 一键安装 curl -fsSL https://ollama.com/install.sh | sh # Windows(管理员PowerShell) winget install Ollama.Ollama

第二步:下载并启动模型

# 入门推荐(轻量,1GB) ollama run qwen2.5:1.5b # 主流推荐(综合效果,4.7GB) ollama run qwen2.5:7b # 推理增强版 ollama run deepseek-r1:7b

第三步:验证本地 API 服务

Ollama 默认在 http://localhost:11434 提供 OpenAI 兼容 API,验证命令:

curl http://localhost:11434/v1/models

第四步:配置 OpenClaw

编辑配置文件 ~/.openclaw/openclaw.json:

{

"models": {

"providers": {

"ollama": {

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "no-key",

"api": "openai-completions",

"models": [

{

"id": "qwen2.5:7b",

"name": "Qwen2.5 7B Local",

"contextWindow": 32768,

"maxTokens": 8192

},

{

"id": "qwen2.5:1.5b",

"name": "Qwen2.5 1.5B Local",

"contextWindow": 32768,

"maxTokens": 4096

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama/qwen2.5:7b"

}

}

}

}第五步:重启网关

openclaw gateway restart

3.2 方案二:使用 LM Studio 部署本地模型

LM Studio 提供图形化界面,适合不熟悉命令行的用户。

第一步:下载安装 LM Studio

访问 https://lmstudio.ai/download,根据系统下载对应版本。

第二步:下载模型

- 打开 LM Studio,点击左侧「Model Hub」

- 搜索「qwen2.5」或你需要的模型

- 选择量化版本(推荐 Q4_K_M 版本,平衡性能与显存)

- 点击「Download」下载

第三步:开启 API 服务

- 点击左侧「Server」

- 开启「Enable Server」和「Enable OpenAI Compatibility」

- 默认端口为 1234,无需修改

- 在「Advanced Settings」中设置 Context Window 为 100000

第四步:验证 API 服务

curl http://localhost:1234/v1/models

第五步:配置 OpenClaw

{

"models": {

"providers": {

"lmstudio": {

"baseUrl": "http://localhost:1234/v1",

"apiKey": "lmstudio-key",

"api": "openai-completions",

"models": [

{

"id": "qwen2.5-32b",

"name": "Qwen2.5 32B Local",

"contextWindow": 100000,

"maxTokens": 8192,

"cost": {

"input": 0,

"output": 0

}

}

]

}

}

}

}3.3 本地模型的硬件要求参考

| 模型规模 | 显存需求 | 适用硬件 | 典型模型 |

|---|---|---|---|

| 1B-3B | 2-4GB | CPU/低端显卡 | Qwen2.5 1.5B、Phi-3 Mini |

| 7B-9B | 6-8GB | RTX 3060/4060 | Qwen2.5 7B、DeepSeek 7B |

| 27B-35B | 16-24GB | RTX 4090/5090 | Qwen2.5 32B、DeepSeek 32B |

量化版本选择建议:

- Q4_K_M:平衡性能与显存,最推荐

- Q5_K_M:精度稍高,显存增加约 20%

- Q8_0:精度接近原版,显存翻倍

第四章:高级配置——多模型智能降级与切换

4.1 双模型配置(主模型+降级模型)

配置主模型和降级模型后,当主模型不可用(如 API 超限、服务中断)时,OpenClaw 自动切换到备用模型,实现高可用。

{

"models": {

"mode": "fallback",

"providers": {

"local": {

"baseUrl": "http://localhost:11434/v1",

"apiKey": "no-key",

"api": "openai-completions",

"models": [

{

"id": "qwen2.5:7b",

"name": "Qwen2.5 7B Local"

}

]

},

"cloud": {

"baseUrl": "https://yuanbao.tencentcloudapi.com/v1",

"apiKey": "sk-xxx",

"api": "openai-completions",

"models": [

{

"id": "hunyuan-turbo",

"name": "混元 Turbo"

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "local/qwen2.5:7b",

"fallback": "cloud/hunyuan-turbo"

}

}

}

}4.2 环境变量管理 API Key(推荐)

为保护 API Key 安全,建议使用环境变量而非明文写入配置文件。

设置环境变量:

# Linux/MacOS export YUANBAO_API_KEY="sk-xxx" export DEEPSEEK_API_KEY="sk-yyy" # Windows PowerShell $env:YUANBAO_API_KEY="sk-xxx"

配置文件引用:

{

"models": {

"providers": {

"yuanbao": {

"baseUrl": "https://yuanbao.tencentcloudapi.com/v1",

"apiKey": "${YUANBAO_API_KEY}",

"api": "openai-completions"

}

}

}

}4.3 模型参数调优

根据模型能力,可以配置更详细的参数来优化表现:

{

"models": {

"providers": {

"my-model": {

"baseUrl": "http://localhost:1234/v1",

"apiKey": "xxx",

"models": [

{

"id": "qwen2.5-32b",

"name": "Qwen2.5 32B",

"contextWindow": 100000,

"maxTokens": 8192,

"reasoning": false,

"input": ["text"],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

}

}

]

}

}

}

}参数说明:

contextWindow:模型支持的最大上下文长度,影响记忆能力maxTokens:单次回答的最大 Token 数reasoning:是否支持思考过程(仅部分模型支持)cost:计费参数,本地模型设为 0

第五章:快速配置命令汇总

5.1 命令行方式配置

OpenClaw 提供了非交互式命令行,可在脚本中直接配置模型:

# 添加自定义模型供应商 openclaw onboard \ --auth-choice custom-api-key \ --custom-provider-id my-model \ --custom-base-url http://localhost:8000/v1 \ --custom-model-id qwen2.5-7b \ --custom-api-key "no-key-needed" \ --custom-compatibility openai

5.2 模型管理命令速查

| 命令 | 功能 |

|---|---|

openclaw models list | 列出所有已配置模型 |

openclaw models current | 查看当前默认模型 |

openclaw models set 提供商/模型ID | 切换默认模型 |

openclaw chat --model 模型ID | 临时使用指定模型对话 |

openclaw config get models | 查看模型配置 |

openclaw config set models.providers.xxx.baseUrl URL | 修改模型 API 地址 |

5.3 快速测试模型是否生效

# 测试当前模型 openclaw chat --prompt "你是什么模型?请简要介绍自己" # 指定模型测试 openclaw chat --model yuanbao/hunyuan-turbo --prompt "你好"

如果模型正常响应,说明配置已生效。

第六章:常见问题与解决方案

Q1:修改模型后无法连接怎么办?

排查步骤:

- 检查 API Key 是否正确,注意前后是否有空格

- 确认账号是否有足够 Token 额度(新账号需实名认证)

- 重启 OpenClaw 服务:

openclaw gateway restart - 检查网络是否能访问 API 地址:

curl -I https://api.deepseek.com/v1

Q2:如何确认模型配置已生效?

发送测试消息,如“你现在调用的模型是什么”,如果 AI 能正常响应并说明模型信息,说明配置成功。也可通过 openclaw models current 命令查看当前使用的模型。

Q3:本地模型响应太慢怎么办?

- 选择更小的量化版本(如从 Q5_K_M 换为 Q4_K_M)

- 选择更小的模型(如从 32B 换为 7B)

- 确保 GPU 驱动正常,CPU 推理会明显变慢

- 调整 Context Window 长度,过长的上下文会消耗大量显存

Q4:多个模型如何快速切换?

Web 面板中点击右上角模型选择器下拉菜单,或使用命令 openclaw models set 提供商/模型ID。对话内也可直接输入 /model 模型ID 快速切换。

Q5:OpenClaw 能否同时使用多个模型?

可以。通过配置 fallback 降级模型实现自动切换,或通过对话内手动切换。

Q6:云端模型和本地模型如何选择?

| 因素 | 云端模型 | 本地模型 |

|---|---|---|

| 成本 | 按量付费/免费额度 | 完全免费 |

| 性能 | 响应快,算力强 | 取决于本地硬件 |

| 隐私 | 数据上传云端 | 数据不出本地 |

| 联网 | 需要网络 | 可完全离线 |

| 复杂任务能力 | 强(千亿参数) | 较弱(受硬件限制) |

建议组合:日常使用本地模型降成本,复杂任务通过 fallback 自动切换到云端模型。

结语:选对“大脑”,龙虾才能真正干活

OpenClaw 的强大之处在于它的“开放性”——不绑定任何模型,让你自由选择最适合需求的“大脑”。无论是追求极致的代码能力(DeepSeek)、优秀的中文理解(腾讯元宝)、数据隐私保护(本地 Ollama),还是零成本长期使用(元宝免费版、豆包),都能找到匹配方案。

配置的核心三步骤:

- 获取 API Key(云端)或部署本地服务(Ollama/LM Studio)

- 编辑配置文件

~/.openclaw/openclaw.json添加模型提供商 - 执行

openclaw gateway restart重启生效

现在,动手为你养的“龙虾”换个更聪明的大脑吧——让它在文件整理、代码生成、跨应用协同中真正“说到做到”!

以上就是OpenClaw怎么换大模型?3步免费切换各种大模型配置教程的详细内容,更多关于OpenClaw免费切换各种大模型配置的资料请关注脚本之家其它相关文章!

相关文章

OpenClaw接入大模型API完整教程:2026年Skills开发从零到跑通

这篇文章主要为大家介绍了从零实现 OpenClaw 接入大模型 API 的完整教程,涵盖 Skills 开发全流程,适合想在 OpenClaw 平台上快速跑通大模型接入的开发者参考,需要的朋友可2026-03-21

Windows原生部署OpenClaw并对接千问大模型Qwen的全流程(新手零踩坑)

本文将详细讲解在 Windows 笔记本(无需 WSL)上,通过原生 PowerShell 部署 OpenClaw,并对接 千问大模型(深度求索)大模型的全流程,包含环境搭建、配置接入、功能使用2026-03-17

OpenClaw国内五个主流大模型配置与接入指南:MiniMax、GLM、Kimi、Douba

OpenClaw(原名Moltbot、Clawdbot)是2026年初爆火的开源个人AI助手项目,支持本地部署,兼容多种消息平台,本文将基于最新官方文档,提供五个主流国内大模型的完整配置方2026-03-15

OpenClaw+Ollama+Qwen3.5:cloud/Qwen3:0.6b部署本地离线部署AI大模型(

无需GPU、无需云端API,在Windows10/11电脑上,手把手教你部署Ollama+Qwen3.5:cloud(主力模型)+Qwen3:0.6b(轻量备选)+OpenClaw,实现本地离线运行私人AI,感兴趣的可以2026-03-10

Mac mini上部署配置OpenClaw并接入国产大模型与飞书

本文详细介绍了在Macmini上部署OpenClaw的全过程,包括配置安装及国产大模型接入以及飞书机器人集成,搭建一个的AI助手,满足日常自动化需求,需要的朋友们下面随着小编来一起2026-03-09 这篇文章给大家介绍OpenClaw 使用教程跨平台安装部署、配置大模型 Provider、接入 Ollama、本地 Skills/插件、浏览器控制、搜索 API、Obsidian Skills的相关操作,感兴趣的2026-03-05

这篇文章给大家介绍OpenClaw 使用教程跨平台安装部署、配置大模型 Provider、接入 Ollama、本地 Skills/插件、浏览器控制、搜索 API、Obsidian Skills的相关操作,感兴趣的2026-03-05

最新评论