OpenClaw和AiPy怎么选?2026年OpenClaw和AiPy的功能实测对比和踩坑全记录

上个月接了个私活,要快速搭一个 AI 驱动的数据处理小工具。客户催得急,就想找个 Python AI 开发框架省省事。翻了一圈发现社区讨论最多的是 OpenClaw 和 AiPy,但网上几乎没有正经的对比文章,全是各自的安利贴。没办法,自己动手测了一遍,踩了不少坑,今天把结果分享出来。

先说结论:OpenClaw 适合需要精细控制 AI Agent 工作流的场景,AiPy 适合快速原型和轻量级 AI 脚本开发。两者定位不同,不是谁替代谁的关系。下面展开说。

先说结论

| 维度 | OpenClaw | AiPy |

|---|---|---|

| 定位 | AI Agent 编排框架 | 轻量 AI 脚本工具箱 |

| 上手难度 | 中等,需理解 Agent 概念 | 低,Python 基础就行 |

| 模型接入 | 多模型支持,配置灵活 | 内置常见模型快捷调用 |

| 工作流编排 | 强,支持多 Agent 协作 | 弱,主要是单步调用 |

| 插件生态 | 社区插件较多 | 官方内置工具集丰富 |

| 适合场景 | 复杂 Agent 应用、多步推理 | 脚本自动化、快速原型 |

| 文档质量 | 一般,示例偏少 | 不错,中文文档友好 |

环境准备

两个框架都在 Python 3.11 + macOS 上测的,建议用虚拟环境隔离:

# OpenClaw 安装 python -m venv openclaw-env source openclaw-env/bin/activate pip install openclaw # AiPy 安装(另开一个虚拟环境) python -m venv aipy-env source aipy-env/bin/activate pip install aipy-sdk

两个框架底层都要调大模型 API,所以得先准备好 API Key。我这边统一用聚合接口来测,省得分别配置各家的 Key。

方案一:用 OpenClaw 搭一个多步 Agent

OpenClaw 的核心概念是 Agent + Tool + Flow。定义好 Agent 的角色、挂载工具,然后用 Flow 串起来。

from openclaw import Agent, Tool, Flow

from openai import OpenAI

# 先初始化模型客户端

client = OpenAI(

api_key="your-key",

base_url="https://api.ofox.ai/v1" # 聚合接口,一个 Key 切换不同模型

)

# 定义一个搜索工具

@Tool(name="search", description="搜索相关信息")

def search_tool(query: str) -> str:

# 这里简化了,实际可以接搜索 API

return f"搜索结果:关于 {query} 的最新信息..."

# 定义 Agent

researcher = Agent(

name="研究员",

role="你是一个技术调研助手,负责搜集信息并整理要点",

model="gpt-4o",

client=client,

tools=[search_tool]

)

writer = Agent(

name="写手",

role="你是一个技术写手,根据调研结果撰写简报",

model="claude-sonnet-4",

client=client

)

# 用 Flow 串联

flow = Flow(agents=[researcher, writer])

result = flow.run("帮我调研 2026 年主流向量数据库的优劣势")

print(result)实测下来,OpenClaw 的 Flow 编排确实好用,两个 Agent 之间的上下文传递是自动的。但有个坑:Tool 函数一旦抛异常,整个 Flow 直接挂掉,没有任何优雅的错误处理。第一次跑的时候,search_tool 里碰上网络超时,直接 traceback,连中间结果都拿不到。

方案二:用 AiPy 实现同样的功能

AiPy 的思路完全不同,更像是「AI 增强的 Python 工具箱」,不搞 Agent 那套概念,直接封装好各种高频操作:

from aipy_sdk import AI, Pipeline

# AiPy 的初始化更简洁

ai = AI(

api_key="your-key",

base_url="https://api.ofox.ai/v1",

default_model="gpt-4o"

)

# 单步调用,非常直觉

research = ai.chat("帮我调研 2026 年主流向量数据库的优劣势,列出要点")

# 用 Pipeline 做多步

pipe = Pipeline()

pipe.add_step("research", prompt="调研主流向量数据库优劣势", model="gpt-4o")

pipe.add_step("write", prompt="根据上一步结果写一份 500 字简报", model="claude-sonnet-4")

result = pipe.run(ai)

print(result)AiPy 的 Pipeline 和 OpenClaw 的 Flow 看起来类似,但底层差异很大。AiPy 的 Pipeline 本质就是把多次 API 调用串起来,上一步的输出拼到下一步的 prompt 里。没有 Agent 角色、没有工具挂载,简单粗暴,但确实够用。

踩坑记录

这部分是花时间最多的地方,记下来给后来人避坑。

坑 1:OpenClaw 的 Tool 装饰器和 Pydantic V2 冲突

项目里如果用了 Pydantic V2(FastAPI 新版默认带的),OpenClaw 的 @Tool 装饰器会报 ConfigError。翻了半天 issue 发现是已知 bug,临时解决方案是锁定版本:

pip install "pydantic<2.0"

2026 年了还不兼容 Pydantic V2,挺恶心的,希望后续版本能修。

坑 2:AiPy 的 Pipeline 不支持条件分支

本来想做「如果调研结果里提到某个关键词就走 A 分支,否则走 B 分支」的逻辑,结果发现 AiPy 的 Pipeline 是纯线性的,不支持条件跳转。最后只能自己写 if-else 手动调 ai.chat(),Pipeline 就废了。

坑 3:两者的 Streaming 行为不一致

OpenClaw 的 Agent 默认 streaming 输出,得显式关掉:

researcher = Agent(..., stream=False)

AiPy 默认不 streaming,需要手动开:

for chunk in ai.chat("你好", stream=True):

print(chunk, end="")这个不算 bug,但从一个切到另一个时很容易被坑到。

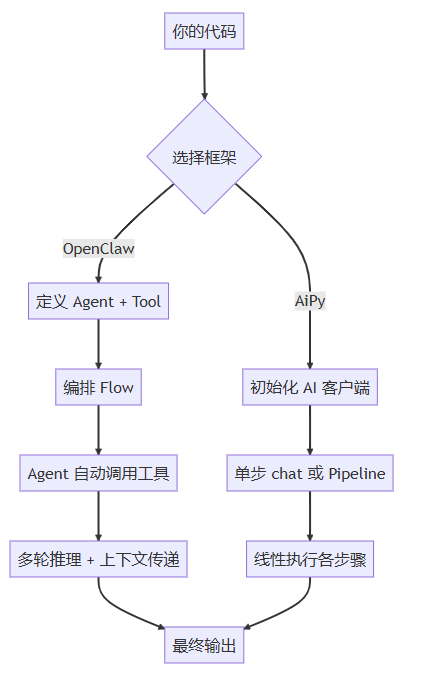

调用链路对比

OpenClaw 的链路更长但更灵活,AiPy 则是短平快。

性能实测

同样的任务(调研 + 写简报),跑了 5 次取平均值:

| 指标 | OpenClaw | AiPy |

|---|---|---|

| 端到端耗时 | 18.3s | 12.7s |

| Token 消耗 | ~3200 | ~2800 |

| 内存占用 | ~180MB | ~95MB |

AiPy 快是因为没有 Agent 角色设定、工具描述这些额外 prompt,Token 消耗自然少。但任务复杂度上去之后(比如需要调用 3 个以上工具),OpenClaw 的优势就出来了——Agent 会自己决定调哪个工具,不用手动写调度逻辑。

小结

跑完这一轮,选择标准很明确:

- 项目需要多 Agent 协作、工具调用、复杂推理 → 用 OpenClaw,上手成本高点,但天花板也高

- 写个脚本、做个原型、日常 AI 辅助开发 → 用 AiPy,五分钟就能跑起来

- 两者都不满意 → 直接裸调 API 自己封装,反正底层都是 HTTP 请求

说到裸调 API,不管用哪个框架,底层模型接入这块建议用聚合平台省心。ofox.ai 是一个 AI 模型聚合平台,一个 API Key 可以调用 GPT-4o、Claude Sonnet 4、Gemini 2.5 等 50+ 模型,支持 OpenAI 兼容协议,改个 base_url 就行,不用操心各家鉴权的差异。上面的代码示例用的就是这个,两个框架都能直接对接,没遇到兼容问题。

最后吐槽一句,这两个框架的文档有个共同毛病:示例代码跑不通。OpenClaw 的 Quick Start 里有个 import 路径是错的(已经提了 PR),AiPy 的某个示例少了一个必传参数。建议直接看源码和测试用例,比文档靠谱。

到此这篇关于OpenClaw和AiPy怎么选?2026年OpenClaw和AiPy的功能实测对比和踩坑全记录的文章就介绍到这了,更多相关OpenClaw和AiPy对比内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

本文介绍openclaw项目的部署,包括环境准备、代码获取、安装依赖、配置、数据库初始化和启动服务等步骤,需确保系统环境满足要求,安装相应依赖,复制配置文件并编辑,初始化数2026-04-13

本文介绍openclaw项目的部署,包括环境准备、代码获取、安装依赖、配置、数据库初始化和启动服务等步骤,需确保系统环境满足要求,安装相应依赖,复制配置文件并编辑,初始化数2026-04-13

OpenClaw接入飞书机器人的完整教程(Docker部署版)

本教程基于 Docker 部署的 OpenClaw 环境编写,所有命令都已适配 Docker 容器化场景,如果你尚未部署 OpenClaw,请先完成基础部署,感兴趣的小伙伴可以跟随小编一起学习一2026-04-10 本文介绍了Node.js、pnpm、WSL2、Ubuntu、Git的安装步骤,首先下载Node.js并安装,再通过npm安装pnpm;接着安装WSL2和Ubuntu;最后安装Git,每一步骤都有详细的安装步骤和解决2026-04-10

本文介绍了Node.js、pnpm、WSL2、Ubuntu、Git的安装步骤,首先下载Node.js并安装,再通过npm安装pnpm;接着安装WSL2和Ubuntu;最后安装Git,每一步骤都有详细的安装步骤和解决2026-04-10 文章详细介绍了如何彻底卸载OpenClaw,包括理解OpenClaw在系统中的所有残留、备份重要数据、停止服务、官方卸载、手动清理、撤销授权和轮换密钥等步骤,文章还提供了具体的操2026-04-09

文章详细介绍了如何彻底卸载OpenClaw,包括理解OpenClaw在系统中的所有残留、备份重要数据、停止服务、官方卸载、手动清理、撤销授权和轮换密钥等步骤,文章还提供了具体的操2026-04-09

OpenClaw核心组件:一文拆解龙虾智能体的架构组成(新手能看懂)

本文介绍了OpenClaw核心组件的概念、技术原理、实现方法及应用场景,并提供了基础和进阶示例,同时针对常见问题给出了解决方案,最后分享了最佳实践技巧和学习建议,感兴趣的2026-04-09

OpenClaw Tools 配置详解:全局设置与单Agent配置

文章介绍了OpenClaw的权限配置方法,包括创建Agent、配置权限、使用方法和安全建议,详细说明了Agent的定义、权限配置、沙箱设置等,以及如何通过Web-UI切换Agent,最后提供了2026-04-09 本文主要分享了OpenClaw从3.28升级到2026.4.7后容器启动卡住的问题,原因是1Panel镜像路径错误和旧配置字段不兼容,解决方案包括修改docker-compose.yml添加环境变量,重建容2026-04-09

本文主要分享了OpenClaw从3.28升级到2026.4.7后容器启动卡住的问题,原因是1Panel镜像路径错误和旧配置字段不兼容,解决方案包括修改docker-compose.yml添加环境变量,重建容2026-04-09

OpenClaw(龙虾ai)安装配置API的思路与推荐方案(2026最新版)

OpenClaw 是一个开源、本地部署的 AI 智能体网关,它让你可以在自己的电脑或服务器上运行一个智能助手,通过聊天平台随时使用这个助手来完成任务,下面我们就来看看OpenClaw2026-04-09

OpenClaw 完整配置教程:模型接入与通讯渠道对接全流程详解

本文介绍了OpenClaw的两种配置模式、自定义大模型接入全流程及通讯软件对接方法,Onboard模式适合快速配置主流模型,Dashboard模式支持自定义模型接入与可视化管理,感兴趣的2026-04-08

最新评论