详解Claude Code 接入本地大模型Qwen3.6 进行代码开发(vLLM 部署 + 环境配置)

背景

Claude Code 是 Anthropic 推出的智能编码命令行工具,默认使用 Claude 系列模型。但我们可以通过指定自定义 API 端点,将其连接到本地部署的 Qwen3.6 模型,实现“本地模型 + 强大编码助手”的组合。

本文将带你完成:

一、环境准备与模型部署

1.1 安装 Docker

请确保你的系统已安装 Docker 并支持 GPU(NVIDIA Container Toolkit)。

1.2 创建 docker-compose.yml

在合适的位置创建项目目录,例如 ~/vllm-qwen,并在其中新建 docker-compose.yml 文件,内容如下:

version: '3.8'

services:

vllm-qwen:

image: vllm/vllm-openai:cu130-nightly

container_name: vllm-qwen36-35B-A3B-FP8

restart: unless-stopped

ipc: host

ports:

- "8000:8000"

volumes:

- /app/vllm/data/models:/root/.cache/modelscope # 模型缓存目录,可按需修改

environment:

- VLLM_USE_MODELSCOPE=true

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: all

capabilities: [gpu]

command:

- --model

- "Qwen/Qwen3.6-35B-A3B-FP8"

- --tensor-parallel-size

- "1"

- --gpu-memory-utilization

- "0.8"

- --served-model-name

- "Qwen3.6-35B-A3B-FP8"

- --enable-prefix-caching

- --enable-auto-tool-choice

- --default-chat-template-kwargs

- '{"enable_thinking": false}'

- --tool-call-parser

- "qwen3_coder"

- --max-model-len

- "196608"

- --max-num-batched-tokens

- "8192"

- --enable-chunked-prefill

- --max-num-seqs

- "32"

- --kv-cache-dtype

- "fp8"1.3 启动模型服务

在 docker-compose.yml 所在目录执行:

docker compose up -d

服务启动后会监听本机 8000 端口。

1.4 验证部署

使用 curl 检查模型列表:

curl http://127.0.0.1:8000/v1/models

正常返回应包含 Qwen3.6-35B-A3B-FP8。

二、安装 Claude Code

Claude Code 支持多种安装方式,可根据你的系统选择。

2.1 通过官方脚本安装(推荐)

macOS / Linux / WSL(Linux 子系统)

打开终端,执行:

curl -fsSL https://claude.ai/install.sh | bash

安装完成后重启终端或执行 source ~/.bashrc(或 ~/.zshrc)。

Windows PowerShell(管理员模式运行)

irm https://claude.ai/install.ps1 | iex

Windows CMD(命令提示符)

curl -fsSL https://claude.ai/install.cmd -o install.cmd && install.cmd && del install.cmd

2.2 通过 npm 安装(适用于已安装 Node.js 的用户)

npm install -g @anthropic-ai/claude-code

安装后,执行一次初始化(非必须,但建议):

claude install

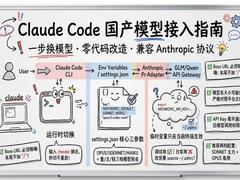

三、配置 Claude Code 使用本地 Qwen3.6

3.1 设置环境变量

将 Claude Code 指向本地 vLLM 服务。当前服务运行在 127.0.0.1:8000,如果其他机器使用可以ifconfig查看服务器的ip地址,认证 Token 可随意设置(vLLM 默认不校验,但需要占位符)。

Linux / macOS / WSL (bash/zsh)

export ANTHROPIC_BASE_URL="http://127.0.0.1:8000" export ANTHROPIC_AUTH_TOKEN="your_key"

若想永久生效,可将这两行追加到 ~/.bashrc 或 ~/.zshrc。

Windows PowerShell

$env:ANTHROPIC_BASE_URL="http://127.0.0.1:8000" $env:ANTHROPIC_AUTH_TOKEN="your_key"

Windows CMD

set ANTHROPIC_BASE_URL=http://127.0.0.1:8000 set ANTHROPIC_AUTH_TOKEN=your_key

3.2 指定模型启动 Claude Code

环境变量设置完毕后,使用 --model 参数指定模型名称(必须与 vLLM 启动参数 --served-model-name 一致):

claude --model Qwen3.6-35B-A3B-FP8

首次运行会提示登录,由于我们使用的是自定义端点,可以随意输入邮箱或直接回车跳过。

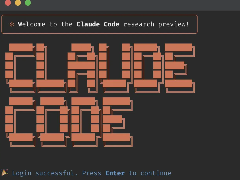

启动成功后,你将看到类似如下的交互界面:

Claude Code v2.x.x Type /help for commands, /exit to quit. > 你好,请帮我写一个 Python 冒泡排序

到此这篇关于Claude Code 接入本地大模型Qwen3.6 进行代码开发(vLLM 部署 + 环境配置)的文章就介绍到这了,更多相关Claude Code 接入大模型Qwen内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

本文介绍了配置一个代理服务器来转发Claude和Qwen的请求,以便兼容不同的请求格式,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋2026-05-11

本文介绍了配置一个代理服务器来转发Claude和Qwen的请求,以便兼容不同的请求格式,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋2026-05-11

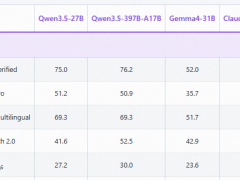

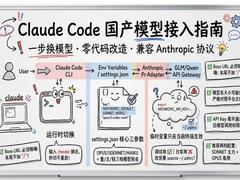

Claude Code接入国产大模型(GLM/Qwen)配置全解析

本文介绍了如何将Claude Code接入国产大模型(GLM/Qwen)的配置方法,并列举了几常见问题和解决方案,文末还总结了配置方法和模型分层建议,希望对大家有一定的帮助2026-05-07

Qwen3.6-27B 本地私有化部署 + Claude Code 连接应用

本文主要介绍 Qwen3.6-27B 的本地私有化部署过程,部署采用vLLM 引擎,以及将 Claude Code 指向使用私有化部署的模型,并且开发一个五子棋的网页小游戏,以及针对开源项目2026-04-29

Claude Code完整指南:MCP、Skills、第三方模型配置一次搞定

Claude Code 是 Anthropic 官方出的命令行工具,直接在终端里跟 Claude 交互,干的事情就是帮你写代码、改代码、跑命令,本文给大家介绍了Claude Code 完整上手指南,MCP、S2026-05-08

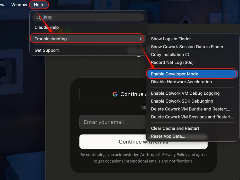

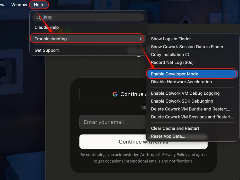

国内直连Claude Code桌面版的全过程:接入全球AI大模型

最新版 Claude Code Desktop(桌面版)已经支持通过图形化界面配置第三方大模型,对于不想反复折腾 CLI、环境变量和本地配置文件的用户来说,这个更新非常实用,本文就给大家2026-05-07

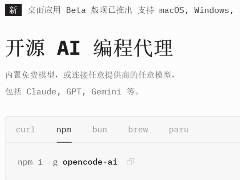

OpenCode安装及配置Claude Opus 4.6模型完整指南

本文介绍了如何从零开始在不同操作系统上安装并配置OpenCode,这是一款100%开源的AI编码代理,文章详细解释了使用NodeJS安装、配置模型以及安装antigravity+geminiclioauth插2026-04-29

Claude Code配置智谱GLM-4.7 模型完整操作文档

本文档详细说明如何在 Claude Code中配置 GLM-4.7 模型,实现基于该模型的代码生成、修复、分析等功能,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参2026-04-10

Claude Code完整安装使用教程(含国内模型接入方案)

文章介绍了AI编程助手ClaudeCode的安装、使用和配置方法,包括安装步骤、接入国内编程模型、简单使用案例及注意事项等内容,需要的朋友可以参考下2026-04-09

最新评论