Ollama无法通过本地IP访问11434端口的解决方案

根据你的描述,你在尝试将 Ollama 的 localhost 地址替换为本地 IP 地址(如 192.168.*.*)时,遇到了网络错误,提示无法连接到服务。但在浏览器中访问 http://<你的IP>:11434 时,Ollama 显示正在运行。以下是可能的原因和解决方案:

一、问题分析

Ollama 默认绑定到 127.0.0.1

默认情况下,Ollama 服务绑定到 127.0.0.1(即 localhost),这意味着它只能接受来自本地主机的连接。如果你尝试通过本地 IP 地址访问,可能会遇到连接问题。

防火墙或网络配置问题

即使你已经在防火墙中允许了 11434 端口,可能存在其他网络配置问题,导致无法通过本地 IP 访问。

Docker 网络配置问题

如果你使用 Docker 部署 Ollama,可能需要确保 Docker 容器正确配置了网络,并且端口映射正确。

二、解决方案

1.更改 Ollama 的绑定地址

你可以通过设置环境变量 OLLAMA_HOST 来更改 Ollama 的绑定地址,使其监听所有网络接口:

export OLLAMA_HOST="0.0.0.0:11434" ollama serve

这将使 Ollama 服务能够接受来自任何 IP 地址的连接。

2.检查防火墙和安全软件

确保防火墙或安全软件没有阻止 11434 端口的流量。你可以暂时关闭防火墙进行测试:

sudo systemctl stop firewalld # 对于 CentOS # 或 sudo ufw disable # 对于 Ubuntu

如果关闭防火墙后可以正常访问,说明需要调整防火墙规则。

3.检查 Docker 网络配置

如果你使用 Docker 部署 Ollama,确保容器正确映射了 11434 端口

docker run -d -p 11434:11434 \ --name ollama \ mintplexlabs/ollama

同时,确保容器内部的 Ollama 服务绑定到 0.0.0.0。

4.使用 Nginx 反向代理

如果上述方法无法解决问题,可以使用 Nginx 设置反向代理,将外部请求转发到 Ollama 服务:

events {}

http {

server {

listen 11435; # 对外暴露的端口

location / {

proxy_pass http://127.0.0.1:11434;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}

}然后运行 Nginx 容器:

docker run -d \

--name nginx-proxy \

-p 11435:11435 \

-v $(pwd)/nginx.conf:/etc/nginx/nginx.conf:ro \

nginx:1.24.0这样,你可以通过 <你的IP>:11435 访问 Ollama 服务。

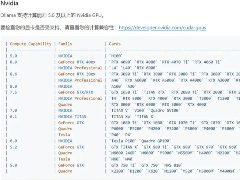

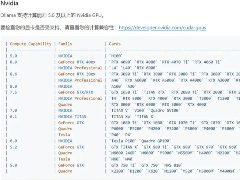

ollama架构图

三、总结

通过更改 Ollama 的绑定地址、检查防火墙配置和 Docker 网络设置,你应该能够解决无法通过本地 IP 访问 11434 端口的问题。如果问题仍然存在,可以尝试使用 Nginx 设置反向代理,将请求转发到 Ollama 服务。

到此这篇关于Ollama无法通过本地IP访问11434端口的解决方案的文章就介绍到这了,更多相关Ollama无法访问11434端口内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

Ollama下载的模型如何导入LLama-Factory进行二次微调

本文介绍如何将Ollama下载的GGUF格式模型转换为Hugging Face格式,并通过LLama-Factory进行LoRA微调,涵盖模型提取、格式转换、训练配置及合并导出全流程,帮助开发者在本地2026-05-12 本文介绍了在Windows系统上配置Ollama使用GPU加速的步骤,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起2026-04-30

本文介绍了在Windows系统上配置Ollama使用GPU加速的步骤,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起2026-04-30 本文介绍了如何利用Ollama和LangChain构建基础AIAgent,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学2026-04-29

本文介绍了如何利用Ollama和LangChain构建基础AIAgent,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学2026-04-29 本文主要介绍了在Ollama平台下载和安装AI模型的方法,包括点击按钮安装和使用指令下载两种方式,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价2026-04-29

本文主要介绍了在Ollama平台下载和安装AI模型的方法,包括点击按钮安装和使用指令下载两种方式,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价2026-04-29

Macmini M4 openclaw第一集:使用ollama和omlx架构对比分析(保姆级教程)

文章介绍了专为苹果macOS优化的oMLX框架,通过安装Home本地运行环境、依赖包和开源客户端面板,实现在Mac上上跑本地模型,并通过配置模型和启动gateway达到加速效果,实测显示2026-04-16 本文详细介绍了Ollama本地大模型运行框架的安装配置方法,特别是如何实现远程访问,文章从基础安装、配置优化、网络设置、远程访问、服务验证到常见问题解决,逐层深入,为开发2026-04-12

本文详细介绍了Ollama本地大模型运行框架的安装配置方法,特别是如何实现远程访问,文章从基础安装、配置优化、网络设置、远程访问、服务验证到常见问题解决,逐层深入,为开发2026-04-12 Ollama是一个轻量级、易于使用的大模型管理和部署工具,主要用于简化大模型的运行和交互,并且为开发者和用户提供了快速加载,管理和调用多种主流大模型的能力,下面我们就2026-04-12

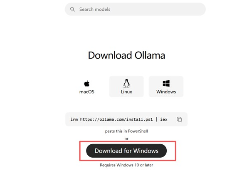

Ollama是一个轻量级、易于使用的大模型管理和部署工具,主要用于简化大模型的运行和交互,并且为开发者和用户提供了快速加载,管理和调用多种主流大模型的能力,下面我们就2026-04-12

Python + Ollama 本地跑大模型:零成本搭建你的私有 AI 助手

文章介绍Ollama本地AI助手的安装方法,从环境准备、快速上手到实战项目,并探讨了其核心优势,包括零成本、零数据风险、零门槛和零妥协,通过使用Ollama,用户可以在本地运行大2026-04-09 本文主要介绍如何在 Windows 系统快速部署 Ollama 开源大语言模型运行工具,并安装 Open WebUI 结合 cpolar 内网穿透软件,实现在公网环境也能访问你在本地内网搭建的 llam2026-04-07

本文主要介绍如何在 Windows 系统快速部署 Ollama 开源大语言模型运行工具,并安装 Open WebUI 结合 cpolar 内网穿透软件,实现在公网环境也能访问你在本地内网搭建的 llam2026-04-07 本文主要介绍了三种快速下载OLLAMA的方法小结,文中通过图文步骤介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧2026-03-31

本文主要介绍了三种快速下载OLLAMA的方法小结,文中通过图文步骤介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧2026-03-31

最新评论