OpenClaw调用Cursor的实现示例

发布时间:2026-03-19 11:20:49 作者:张3蜂  我要评论

我要评论

本文主要介绍了OpenClaw调用Cursor的实现示例,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧

一、安装Cursor Agent CLI

https://cursor.com/cn/blog/cli

# Install curl https://cursor.com/install -fsSL | bash # Start CLI with a prompt agent chat "找到一个错误并修复它"

可能有个小插曲:

现在用的是bash还是zsh echo $SHELL 情况A:如果你用的是zsh(Mac默认) 复制粘贴这三行(一行一行执行): echo 'export PATH="$HOME/.local/bin:$PATH"' >> ~/.zshrc source ~/.zshrc agent 情况B:如果你用的是bash(很多Linux默认) 复制粘贴这三行(一行一行执行): echo 'export PATH="$HOME/.local/bin:$PATH"' >> ~/.bashrc source ~/.bashrc agent

二、使用Cursor Agent CLI

# Start CLI with a prompt agent chat "找到一个错误并修复它"

三、技能市场是有专门的Cursor技能的->Cursor CLI Agent

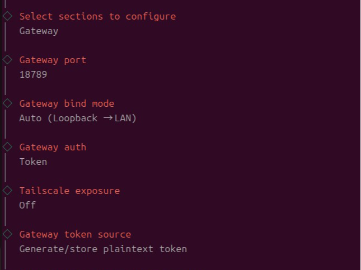

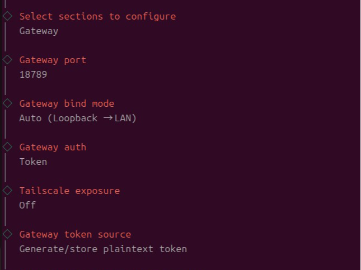

四、让OpenClaw自动安装Cursor CLI Agent

到此这篇关于OpenClaw调用Cursor的实现示例的文章就介绍到这了,更多相关OpenClaw调用Cursor内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

一文教你OpenClaw Docker 部署并调用本地Qwen3.5 9B模型

本文详细介绍了在 Ubuntu 24.04 系统上通过 Docker 部署 Ollama 并运行 Qwen3.5-9B的完整流程,同时对接 OpenClaw 实现 Web 交互,文中通过示例代码介绍的非常详细,需要的2026-03-12 本文基于社区最新实践,手把手教你如何利用 OpenClaw 的日志系统,快速定位并解决常见问题,文中的示例代码讲解详细,感兴趣的小伙伴可以跟随小编一起学习一下2026-03-10

本文基于社区最新实践,手把手教你如何利用 OpenClaw 的日志系统,快速定位并解决常见问题,文中的示例代码讲解详细,感兴趣的小伙伴可以跟随小编一起学习一下2026-03-10

OpenClaw使用Ollama本地模型的实现(支持工具调用))

Ollama 是一个本地 LLM 运行时,可以轻松在你的机器上运行开源模型,OpenClaw 通过 Ollama 的 OpenAI 兼容 API 进行集成,下面就来详细的介绍一下,感兴趣的可以了解一下2026-03-06

最新评论