OpenClaw接入本地Ollama的全流程步骤

1. 概述

本手册介绍如何在 OpenClaw 中配置本地 Ollama 服务。Ollama 是一个开源的本地大语言模型运行框架,支持在本地机器上运行多种开源模型,如 Llama、DeepSeek、Qwen 等。

适用范围:

- 希望在本地运行 AI 模型的用户

- 需要离线使用 OpenClaw 的用户

- 关注数据隐私的用户

- 想要降低 API 调用成本的用户

Ollama 的优势:

- 本地运行:数据不离开本地机器,保护隐私

- 离线可用:无需网络连接即可使用

- 开源免费:无需支付 API 费用

- 模型丰富:支持多种开源大语言模型

2. 环境准备

2.1 安装 Ollama

macOS

# 使用 Homebrew 安装 $ brew install ollama # 或使用官方安装脚本 $ curl -fsSL https://ollama.com/install.sh | sh

Linux

$ curl -fsSL https://ollama.com/install.sh | sh

使用 curl 命令下载 Ollama 安装脚本

上面是我的测试环境配置

安装完成后,Ollama 服务会自动启动。

验证安装:

$ ollama --version ollama version 0.19.0

查看 Ollama 版本和命令帮助

2.2 拉取模型

安装完成后,需要拉取想要使用的模型。根据您的硬件配置选择合适的模型:

提示: 模型大小影响显存/内存占用,请根据机器配置选择:

- 8GB 内存:推荐使用 7B 参数模型

- 16GB 内存:可以使用 13B 参数模型

- 32GB+ 内存:可以使用更大模型或同时运行多个模型

以下是推荐的模型(以 qwen2.5:7b 为例):

# 通义千问 2.5 - 阿里开源模型,中文优化好 $ ollama pull qwen2.5:7b # 其他可选模型: # DeepSeek Coder - 适合编程任务 $ ollama pull deepseek-coder:6.7b # CodeLlama - Meta 的开源代码模型 $ ollama pull codellama:7b # Llama 3 - Meta 的通用大模型 $ ollama pull llama3:8b

查看已安装的模型:

$ ollama list NAME ID SIZE MODIFIED qwen2.5:7b 845dbda0ea48 4.7 GB 28 seconds ago

Ollama 安装成功,服务运行在 127.0.0.1:11434

2.3 验证 Ollama 服务

启动 Ollama 服务(macOS/Windows 通常自动启动):

$ ollama serve

测试 API 是否正常工作:

$ curl http://localhost:11434/api/generate -d '{

"model": "qwen2.5:7b",

"prompt": "Hello, how are you?"

}'

如果能正常返回响应,说明 Ollama 服务运行正常。

2.4 安装 OpenClaw

使用 npm 全局安装 OpenClaw:

# 替换国内的npm源 $ npm config set registry https://registry.npmmirror.com/ # 安装 OpenClaw $ npm install -g openclaw

验证安装:

$ openclaw --version

3. Ollama API 说明

3.1 Ollama 简介

Ollama 是一个本地大语言模型运行框架,特点:

- OpenAI 兼容 API:提供与 OpenAI 兼容的 REST API

- 模型管理:简单的命令行工具管理模型

- 跨平台:支持 macOS、Linux、Windows

- Modelfile:支持自定义模型参数和系统提示词

3.2 API 端点说明

Ollama 默认监听 http://localhost:11434,提供以下 API:

| 端点 | 说明 |

|---|---|

POST /api/generate | 生成文本(非流式/流式) |

POST /api/chat | 对话模式 |

POST /api/embeddings | 获取文本嵌入向量 |

GET /api/tags | 列出本地模型 |

POST /api/pull | 拉取模型 |

OpenAI 兼容端点:

| 端点 | 说明 |

|---|---|

POST /v1/chat/completions | OpenAI 兼容的对话 API |

POST /v1/embeddings | OpenAI 兼容的嵌入 API |

GET /v1/models | 列出可用模型 |

3.3 支持的模型

以下是 Ollama 支持的部分编程相关模型:

| 模型 | 参数 | 大小 | 特点 |

|---|---|---|---|

| qwen2.5 | 7B | 4.7GB | 中文优化好,支持 32K 上下文 |

| qwen2.5-coder | 7B | 4.6GB | 专为代码生成优化 |

| deepseek-coder | 6.7B | 3.8GB | 专为代码生成优化 |

| deepseek-coder | 33B | 18GB | 更强的代码能力 |

| codellama | 7B | 3.8GB | Meta 开源代码模型 |

| codellama | 13B | 7.4GB | 更强的代码理解 |

| llama3 | 8B | 4.7GB | 通用能力强 |

| mistral | 7B | 4.1GB | 推理能力强 |

4. 启动服务

4.1 运行 onboard 命令

完成 Ollama 安装和模型拉取后,启动 OpenClaw 服务:

$ openclaw onboard

4.2 向导配置步骤

步骤 1:安全提示和配置确认

首先确认 "I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue?" 选择 Yes

选择 Setup mode: QuickStart

系统会检测现有配置,显示如下信息:

Existing config detected workspace: ~/.openclaw/workspace model: ollama/qwen2.5:7b gateway.mode: local gateway.port: 18789 gateway.bind: loopback

步骤 2:选择模型提供方,配置 Ollama 连接

在 Model/auth provider 列表中,选择 Ollama。

配置以下选项:

- Model/auth provider:

Ollama - Ollama base URL:

http://127.0.0.1:11434(默认本地地址) - Ollama mode: 选择 Local (Local models only)

- Default model: 选择已下载的模型,如

ollama/qwen2.5:7b (ctx 32k)

步骤 3:配置搜索提供方(可选)

选择搜索提供方,如 DuckDuckGo Search (experimental)(无需 API Key)。

步骤 4:完成配置并重启

配置完成后,选择 Restart 重启服务。

4.3 验证服务启动

服务启动成功后,终端会显示类似以下信息:

OpenClaw Gateway running on http://127.0.0.1:18789 WebUI: http://127.0.0.1:18789/?token=YOUR_TOKEN

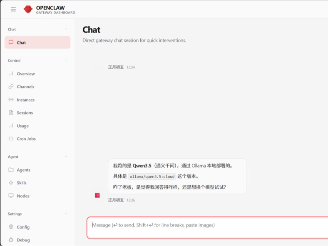

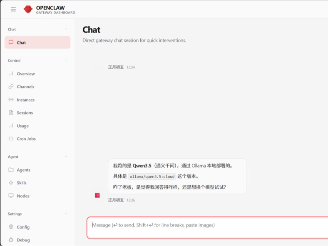

5. 访问 WebUI

服务启动后,可在浏览器中访问:

http://127.0.0.1:18789/?token=YOUR_TOKEN

或使用 localhost:

http://localhost:18789/?token=YOUR_TOKEN

WebUI 界面会显示当前使用的模型:Default (qwen2.5:7b - ollama),表示已成功连接到本地 Ollama 服务。

注意: Token 在配置文件的 gateway.auth.token 字段中查看。

6. 常见问题

Q1: Ollama 服务无法启动?

检查端口占用:

$ lsof -i :11434

查看 Ollama 日志:

$ ollama serve 2>&1

检查环境变量:

# 如需修改监听地址 $ export OLLAMA_HOST=0.0.0.0:11434

Q2: 模型下载很慢?

可以配置镜像源加速下载:

# 设置环境变量使用镜像 $ export OLLAMA_MODELS=/path/to/models

或使用代理:

$ export HTTPS_PROXY=http://your-proxy:port $ ollama pull qwen2.5:7b

Q3: 显存/内存不足?

减小模型大小:

- 使用量化版本(如

:q4_0后缀) - 选择更小的模型(如 7B 替代 13B)

配置 Ollama 使用 CPU:

$ export OLLAMA_NO_GPU=1 $ ollama serve

Q4: OpenClaw 无法连接到 Ollama?

检查 Ollama 服务状态:

$ curl http://127.0.0.1:11434/api/tags

检查配置文件中的 baseUrl:

- 确保 baseUrl 正确设置为

http://127.0.0.1:11434/v1 - 如果 Ollama 在远程服务器,使用对应 IP 地址

防火墙问题:

- 确保防火墙允许 11434 端口访问

- 检查 SELinux/AppArmor 设置

Q5: Token 忘记了怎么办?

查看配置文件:

$ cat .openclaw/openclaw.json | grep token

Q6: 如何更新模型?

# 重新拉取最新版本 $ ollama pull qwen2.5:7b

Q7: 如何删除模型?

$ ollama rm qwen2.5:7b

以上就是OpenClaw接入本地Ollama的全流程步骤的详细内容,更多关于OpenClaw接入本地Ollama的资料请关注脚本之家其它相关文章!

相关文章

还在为天价API费用发愁,受够了网络波动导致AI服务中断,本文将带你真正100%本地运行的AI助手解决方案,只需跟着以下步骤操作,你的电脑将变身全能AI工作站,还能多模型自2026-03-19

还在为天价API费用发愁,受够了网络波动导致AI服务中断,本文将带你真正100%本地运行的AI助手解决方案,只需跟着以下步骤操作,你的电脑将变身全能AI工作站,还能多模型自2026-03-19 本文详细介绍了在Mac上本地安装和配置OpenClaw,包括下载模型、搭建环境、配置agentskills等步骤,文中通过示例代码介绍的非常详细,需要的朋友们下面随着小编来一起学习学2026-03-11

本文详细介绍了在Mac上本地安装和配置OpenClaw,包括下载模型、搭建环境、配置agentskills等步骤,文中通过示例代码介绍的非常详细,需要的朋友们下面随着小编来一起学习学2026-03-11

Windows本地部署OpenClaw并连接Ollama模型的完整指南

本文档基于实际部署经验编写,旨在帮助大家在 Windows 系统上从零开始搭建 OpenClaw,并连接本地 Ollama 模型(如 Qwen2.5 或 Qwen3),使其具备完整的智能体能力,有需要的2026-03-10

OpenClaw+Ollama+Qwen3.5:cloud/Qwen3:0.6b部署本地离线部署AI大模型(

无需GPU、无需云端API,在Windows10/11电脑上,手把手教你部署Ollama+Qwen3.5:cloud(主力模型)+Qwen3:0.6b(轻量备选)+OpenClaw,实现本地离线运行私人AI,感兴趣的可以2026-03-10

OpenClaw使用Ollama本地模型的实现(支持工具调用))

Ollama 是一个本地 LLM 运行时,可以轻松在你的机器上运行开源模型,OpenClaw 通过 Ollama 的 OpenAI 兼容 API 进行集成,下面就来详细的介绍一下,感兴趣的可以了解一下2026-03-06 本指南重点介绍 OpenClaw + Ollama,我还会讲解最常见的问题、API 模式的重要性、如何设置本地+云端混合流程,以及如何避免本地模型输出过于冗长,感兴趣的朋友跟随小编一起2026-03-05

本指南重点介绍 OpenClaw + Ollama,我还会讲解最常见的问题、API 模式的重要性、如何设置本地+云端混合流程,以及如何避免本地模型输出过于冗长,感兴趣的朋友跟随小编一起2026-03-05

Linux环境下配置openclaw并连接到局域网ollama模型

本文介绍了如何在Linux环境下配置OpenClaw并连接到局域网内的ollama模型,包括环境准备、部署步骤、配置provider和model、飞书插件安装与配置,以及消息测试和定时任务设置,2026-03-04

最新评论