openclaw配置本地模型ollama的完整指南

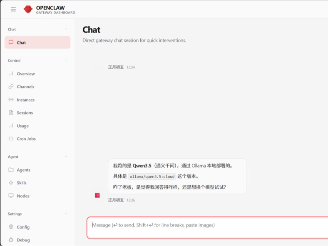

wins10 使用ollama工具下载本地模型qwen3:1.7b ,在wsl(ubuntu)中安装 openclaw,在配置openclaw模型时找不到ollama下载的qwen3:1.7b的模型,应该怎么解决使得在配置openclaw时能够选中本地下载的模型,请从专业角度给出详细的解决方案和步骤

问题分析:

Ollama 在 Windows 10 上安装的模型存储在 Windows 文件系统中,而 WSL (Ubuntu) 默认无法直接访问这些模型文件。要解决这个问题,需要让 WSL 能够访问 Windows 文件系统中的 Ollama 模型目录。

解决方案和步骤:

1.确定 Ollama 模型在 Windows 中的存储位置:

Ollama 在 Windows 上默认将模型存储在:C:\Users[你的用户名].ollama\models

可以通过以下命令确认:

# 在 PowerShell 或 CMD 中执行 echo %USERPROFILE%.ollama\models

2.在 WSL 中访问 Windows 文件系统:

- WSL 可以通过

/mnt/c/路径访问 Windows 的 C 盘 - Ollama 模型在 WSL 中的路径应该是:

/mnt/c/Users/[你的用户名]/.ollama/models

3.在 WSL 中创建符号链接,将 Ollama 模型目录链接到 OpenClaw 可以访问的位置:

# 在 WSL Ubuntu 中执行 # 创建 OpenClaw 模型目录(如果不存在) mkdir -p ~/.openclaw/models # 创建符号链接 ln -s /mnt/c/Users/[你的用户名]/.ollama/models ~/.openclaw/models/ollama

4.配置 OpenClaw 使用 Ollama 模型:

打开 OpenClaw 配置文件(通常在 ~/.openclaw/config.yaml 或类似位置)

添加或修改模型路径配置:

models:

- name: qwen3:1.7b

path: ~/.openclaw/models/ollama/qwen3:1.7b

provider: ollama5.验证配置是否正确:

# 在 WSL 中执行 ls -la ~/.openclaw/models/ollama # 应该能看到 qwen3:1.7b 模型文件 # 测试 OpenClaw 是否能识别模型 openclaw list models

6.如果上述方法不工作,可以尝试以下替代方案:

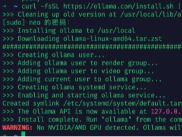

方案 A:直接在 WSL 中安装 Ollama

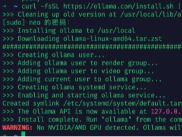

# 在 WSL Ubuntu 中执行 curl -fsSL https://ollama.com/install.sh | sh # 然后下载模型 ollama pull qwen3:1.7b

方案 B:将 Windows 上的 Ollama 模型复制到 WSL

# 在 WSL Ubuntu 中执行 mkdir -p ~/.ollama/models cp -r /mnt/c/Users/[你的用户名]/.ollama/models/* ~/.ollama/models/

7.确保 OpenClaw 有足够的权限访问模型文件:

# 在 WSL 中执行 chmod -R 755 ~/.openclaw/models/ollama

8.如果使用的是 WSL 2,可能需要配置 WSL 访问 Windows 文件系统的性能优化:

在 Windows 用户目录下创建 .wslconfig 文件(如果不存在)

添加以下内容:

[wsl2] # 启用 WSL 2 的性能优化 memory=4GB processors=2 swap=2GB localhostForwarding=true

9.重启 WSL 以应用更改:

# 在 Windows PowerShell 或 CMD 中执行 wsl --shutdown # 然后重新打开 WSL Ubuntu

10.最后,重新启动 OpenClaw 并检查是否能识别模型:

# 在 WSL 中执行 openclaw restart openclaw list models

通过以上步骤,应该能够解决 OpenClaw 无法识别 Windows 上 Ollama 下载的模型的问题。关键在于正确建立 WSL 和 Windows 文件系统之间的连接,并确保 OpenClaw 能够访问到模型文件。

到此这篇关于openclaw配置本地模型ollama的完整指南的文章就介绍到这了,更多相关openclaw配置ollama内容请搜索脚本之家以前的文章或继续浏览下面的相关文章,希望大家以后多多支持脚本之家!

相关文章

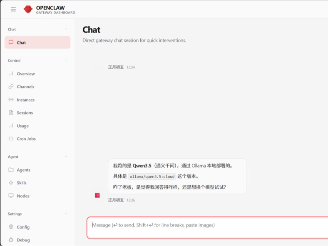

本文介绍了如何在Ollama中安装并集成OpenClaw,首先安装OpenClaw,然后使用Ollama拉取本地模型并完成对接,实现本地免费运行,文中详细描述了安装步骤和配置方法,并提供了常见2026-04-07

本文介绍了如何在Ollama中安装并集成OpenClaw,首先安装OpenClaw,然后使用Ollama拉取本地模型并完成对接,实现本地免费运行,文中详细描述了安装步骤和配置方法,并提供了常见2026-04-07 这篇文章主要为大家介绍了如何在 OpenClaw 中配置本地 Ollama 服务,Ollama 是一个开源的本地大语言模型运行框架,支持在本地机器上运行多种开源模型,如 Llama、DeepSeek、2026-04-03

这篇文章主要为大家介绍了如何在 OpenClaw 中配置本地 Ollama 服务,Ollama 是一个开源的本地大语言模型运行框架,支持在本地机器上运行多种开源模型,如 Llama、DeepSeek、2026-04-03 还在为天价API费用发愁,受够了网络波动导致AI服务中断,本文将带你真正100%本地运行的AI助手解决方案,只需跟着以下步骤操作,你的电脑将变身全能AI工作站,还能多模型自2026-03-19

还在为天价API费用发愁,受够了网络波动导致AI服务中断,本文将带你真正100%本地运行的AI助手解决方案,只需跟着以下步骤操作,你的电脑将变身全能AI工作站,还能多模型自2026-03-19 本文详细介绍了在Mac上本地安装和配置OpenClaw,包括下载模型、搭建环境、配置agentskills等步骤,文中通过示例代码介绍的非常详细,需要的朋友们下面随着小编来一起学习学2026-03-11

本文详细介绍了在Mac上本地安装和配置OpenClaw,包括下载模型、搭建环境、配置agentskills等步骤,文中通过示例代码介绍的非常详细,需要的朋友们下面随着小编来一起学习学2026-03-11

Windows本地部署OpenClaw并连接Ollama模型的完整指南

本文档基于实际部署经验编写,旨在帮助大家在 Windows 系统上从零开始搭建 OpenClaw,并连接本地 Ollama 模型(如 Qwen2.5 或 Qwen3),使其具备完整的智能体能力,有需要的2026-03-10

OpenClaw+Ollama+Qwen3.5:cloud/Qwen3:0.6b部署本地离线部署AI大模型(

无需GPU、无需云端API,在Windows10/11电脑上,手把手教你部署Ollama+Qwen3.5:cloud(主力模型)+Qwen3:0.6b(轻量备选)+OpenClaw,实现本地离线运行私人AI,感兴趣的可以2026-03-10

OpenClaw使用Ollama本地模型的实现(支持工具调用))

Ollama 是一个本地 LLM 运行时,可以轻松在你的机器上运行开源模型,OpenClaw 通过 Ollama 的 OpenAI 兼容 API 进行集成,下面就来详细的介绍一下,感兴趣的可以了解一下2026-03-06 本指南重点介绍 OpenClaw + Ollama,我还会讲解最常见的问题、API 模式的重要性、如何设置本地+云端混合流程,以及如何避免本地模型输出过于冗长,感兴趣的朋友跟随小编一起2026-03-05

本指南重点介绍 OpenClaw + Ollama,我还会讲解最常见的问题、API 模式的重要性、如何设置本地+云端混合流程,以及如何避免本地模型输出过于冗长,感兴趣的朋友跟随小编一起2026-03-05

Linux环境下配置openclaw并连接到局域网ollama模型

本文介绍了如何在Linux环境下配置OpenClaw并连接到局域网内的ollama模型,包括环境准备、部署步骤、配置provider和model、飞书插件安装与配置,以及消息测试和定时任务设置,2026-03-04

最新评论